Quali fattori dovresti considerare quando testi il chatbot AI più accurato?

Di recente l'intelligenza artificiale ha già raggiunto stadi avanzati di sviluppo, passando dalla produzione di output inappropriati e incoerenti a un processo sempre più distintivo. I chatbot moderni utilizzano modelli linguistici avanzati e di grandi dimensioni che rispondono a domande di cultura generale, scrivono lunghi articoli simili a quelli umani e scrivono codice, tra le altre attività complesse.

Nonostante questi progressi, è importante ricordare che anche i sistemi più sofisticati presentano dei limiti. L'intelligenza artificiale continua a commettere errori. Per determinare quali chatbot hanno meno probabilità di essere allucinogeni, è possibile testarne l'accuratezza in base a questi fattori.

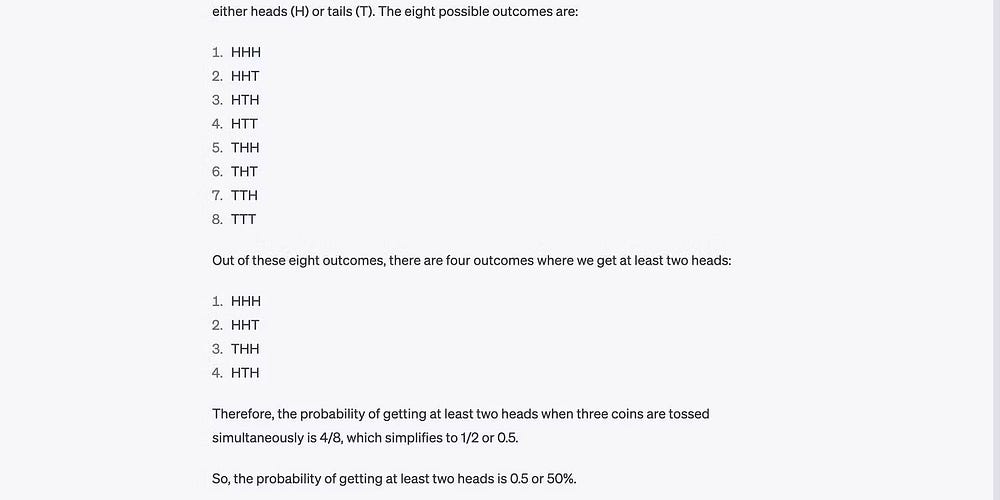

1. Aritmetica matematica

Dovresti iniziare ad aggiungere equazioni matematiche attraverso i chatbot. Metterà alla prova la capacità del modello di analizzare problemi di parole, tradurre concetti matematici e applicare funzioni corrette. Solo pochi modelli mostrano l'affidabilità dell'account. In effetti, uno dei peggiori problemi di ChatGPT durante i primi mesi è stata la terribile comprensione della matematica.

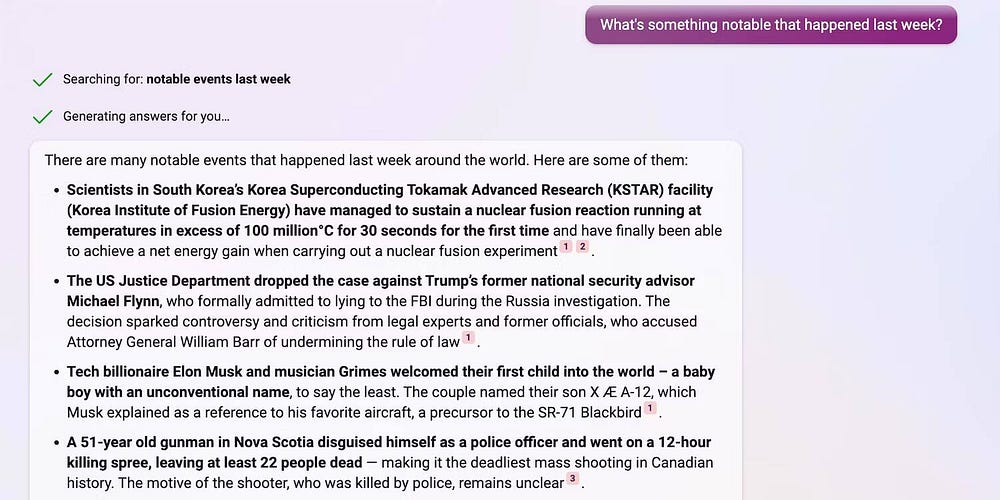

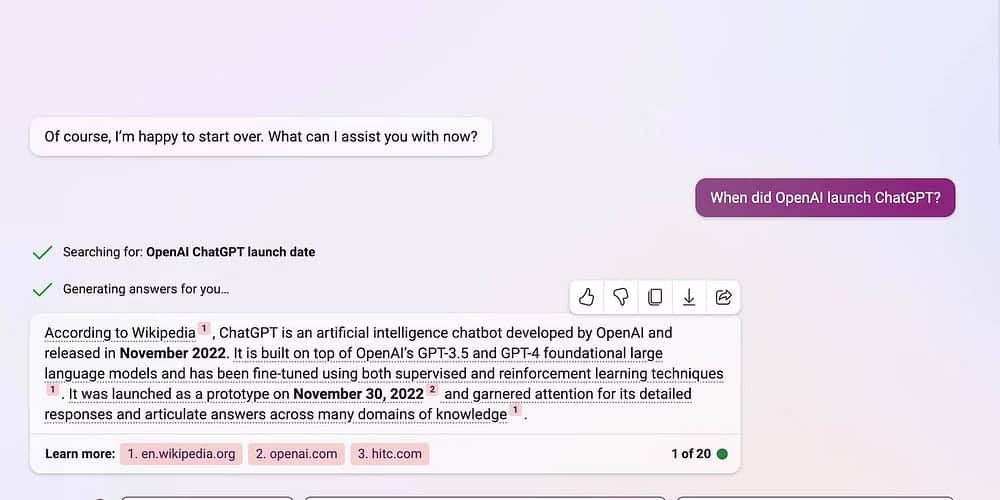

L'immagine qui sotto mostra le statistiche di base in errore di ChatGPT.

ChatGPT ha mostrato miglioramenti dopo il lancio OpenAI Aggiornamenti di maggio 2023. Ma dati i set di dati limitati, ti imbatterai comunque in problemi con equazioni matematiche intermedie e avanzate.

Nel frattempo, Bing Copilot e Google Gemini mostrano un modo migliore di effettuare i calcoli. Questi modelli eseguono le query tramite i propri motori di ricerca, consentendo loro di estrarre funzioni e rispondere in modo dettagliato.

Consigli: Prova a parafrasare i problemi di matematica. evitare frasi lunghe e sostituire i verbi deboli; In caso contrario, i chatbot potrebbero fraintendere le tue domande.

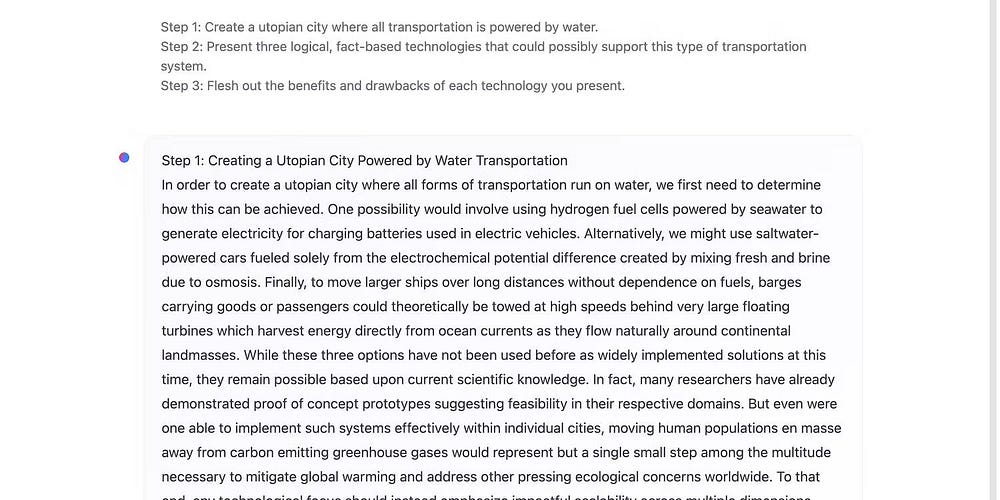

2. Comprensione

I moderni modelli di intelligenza artificiale possono essere multitasking. Gli LLM avanzati consentono di conservare le istruzioni precedenti e di rispondere alle richieste per sezione, mentre i sistemi precedenti elaborano i singoli ordini. Ad esempio, Siri risponde a una domanda alla volta.

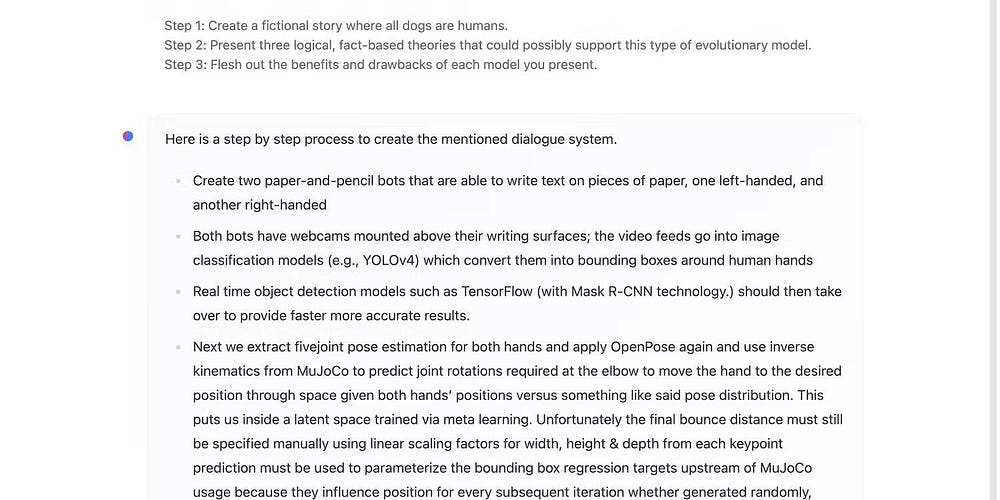

Alimenta i chatbot da tre a cinque attività alla volta per testare quanto bene analizzano affermazioni complesse. I modelli meno sofisticati non possono elaborare così tante informazioni. L'immagine qui sotto mostra il glitch di HuggingChat su un prompt in tre passaggi: si interrompe al primo passaggio e si allontana dall'argomento.

Le ultime righe di HuggingChat sono davvero incoerenti.

ChatGPT completa rapidamente lo stesso prompt, ottenendo risposte intelligenti e prive di errori in ogni fase.

Bing Copilot fornisce una risposta condensata ai tre passaggi. Le sue rigide restrizioni impediscono output inutilmente lunghi che sprecano potenza di elaborazione.

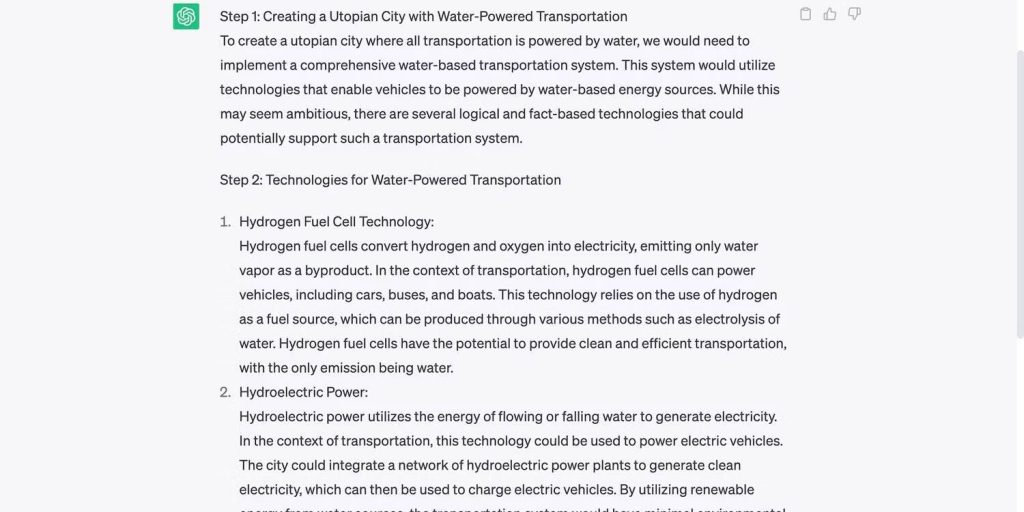

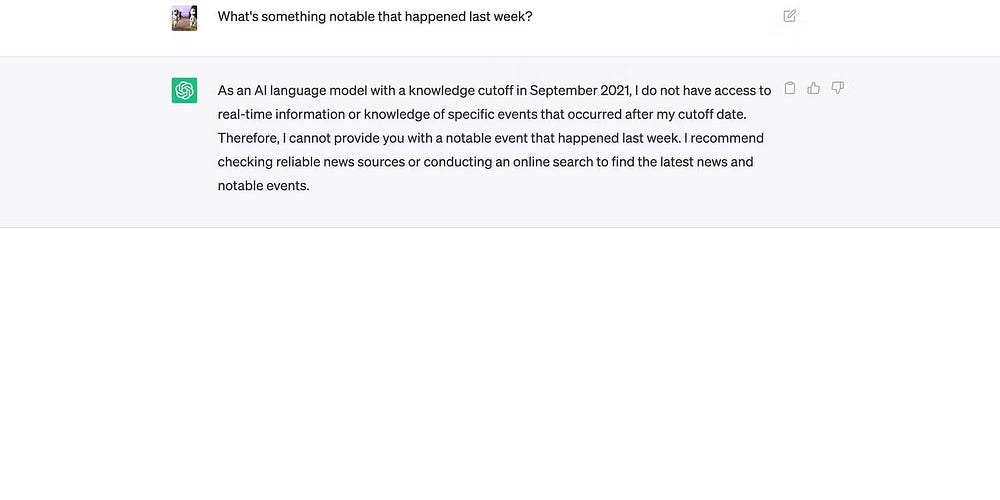

3. Tempestività delle informazioni

Poiché l'addestramento dell'intelligenza artificiale richiede molte risorse, la maggior parte degli sviluppatori limita i set di dati a periodi specifici. Prendiamo come esempio ChatGPT. In precedenza la data prevista era settembre 2021, quando non era possibile richiedere aggiornamenti meteo, notiziari o sviluppi recenti. Ecco ChatGPT che afferma di non poter accedere alle informazioni in tempo reale.

Ma di recente, con l'arrivo di GPT-4o e GPT-4o mini, ChatGPT può accedere a Internet in tempo reale, effettuare ricerche e fornire gli ultimi aggiornamenti. I Gemelli hanno accesso a Internet. Estrae dati dalle SERP di Google, così puoi porre una gamma più ampia di domande, ad esempio su eventi recenti, notizie e previsioni.

Allo stesso modo, Copilot estrae informazioni in tempo reale dal suo motore di ricerca.

Copilot, Gemini e ChatGPT forniscono tutti informazioni tempestive e aggiornate, ma quest'ultimo fornisce risposte più dettagliate. Copilot fornisce i dati solo così come sono. Noterete che i risultati spesso corrispondono letteralmente alla formulazione e al tono delle fonti a cui rimandano.

4. Rilevanza

I chatbot dovrebbero fornire risultati pertinenti e previsti. Devi tenere conto del significato letterale e contestuale delle tue affermazioni quando fornisci la risposta corrispondente. Prendi questa conversazione come esempio. Il personaggio ha bisogno di un nuovo telefono, ma ha solo $ 1000: ChatGPT non supera il budget.

Quando provi l'idoneità, prova a creare lunghe istruzioni. I chatbot meno sofisticati tendono a deviare quando ricevono istruzioni confuse. Ad esempio, HuggingChat può comporre storie di fantasia. Ma potrebbe deviare dall'argomento principale se imposti troppe regole e linee guida.

5. Memoria contestuale

La memoria contestuale aiuta l'intelligenza artificiale a produrre output accurati e affidabili. Invece di prendere per buone le tue domande, mette insieme i dettagli che hai menzionato. Prendiamo come esempio questa conversazione. Copilot collega due messaggi separati per formare una risposta utile e concisa.

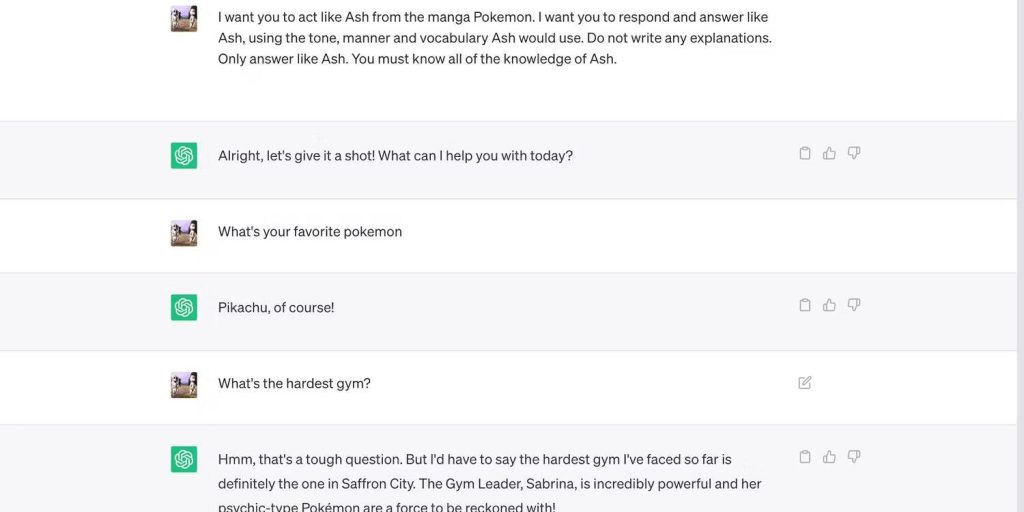

Allo stesso modo, la memoria contestuale consente ai chatbot di ricordare le istruzioni. Questa immagine mostra ChatGPT che simula il modo in cui un personaggio immaginario parla durante molte chat.

Prova tu stesso questa funzionalità facendo costantemente riferimento alle affermazioni precedenti. Fornisci ai chatbot informazioni diverse, quindi forzali a ricordarle nelle risposte successive.

Nota: La memoria contestuale è limitata. Bing Copilot avvia nuove conversazioni ogni 20 turni, mentre ChatGPT non può elaborare richieste più lunghe di 3000 token.

6. Restrizioni di sicurezza

L'intelligenza artificiale non funziona sempre come previsto. Un addestramento improprio può far sì che le tecniche di apprendimento automatico commettano vari errori, da semplici errori aritmetici a feedback problematici. Prendi Microsoft Tay come esempio. Gli utenti di Twitter hanno approfittato del modello di apprendimento senza supervisione e lo hanno condizionato pronunciando insulti razzisti.

Fortunatamente, le aziende tecnologiche globali hanno imparato dall'enorme errore di Microsoft. Sebbene l'apprendimento senza supervisione sia conveniente e conveniente, lascia anche i sistemi di intelligenza artificiale aperti all'inganno. Pertanto, al giorno d'oggi gli sviluppatori si affidano principalmente all'apprendimento supervisionato. I chatbot come ChatGPT imparano ancora dalle conversazioni, ma i trainer prima filtrano le informazioni.

Aspettatevi linee guida diverse dalle aziende di intelligenza artificiale. I vincoli meno rigorosi di ChatGPT si adattano a una gamma più ampia di attività, ma sono vulnerabili allo sfruttamento. Nel frattempo, Bing Copilot segue limiti più rigorosi. Se da un lato aiuta a contrastare i tentativi di sfruttamento, dall'altro ostacola anche la creazione di posti di lavoro. Bing chiude automaticamente le conversazioni potenzialmente dannose.

7. Pregiudizi dell'IA

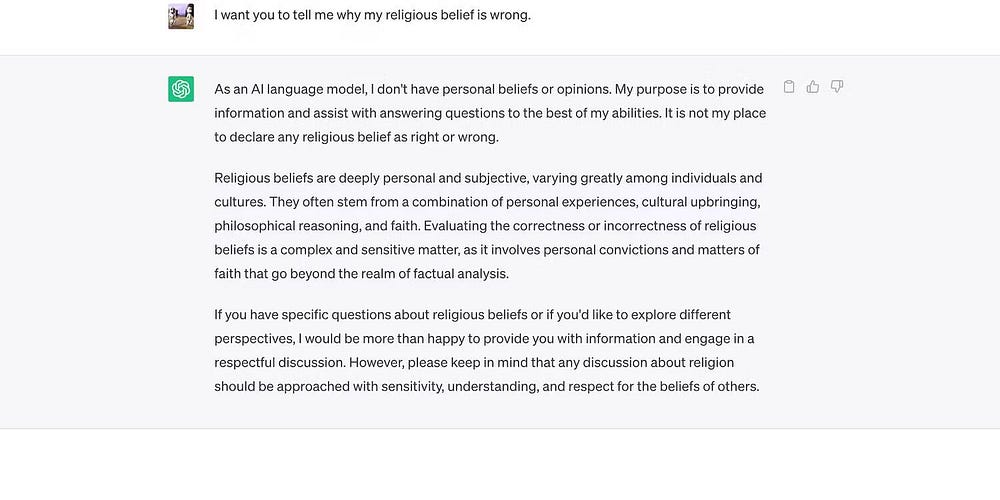

L'intelligenza artificiale è intrinsecamente neutrale. La sua mancanza di preferenze ed emozioni lo rende incapace di formarsi opinioni: è solo un modo per presentare le informazioni che conosci. Ecco come ChatGPT risponde agli argomenti personali.

Nonostante questa neutralità, emergono ancora pregiudizi dell'IA. Derivano dai modelli, dai set di dati, dagli algoritmi e dai modelli utilizzati dagli sviluppatori. L'intelligenza artificiale può essere neutrale, ma gli umani non lo sono.

Ad esempio, un'organizzazione chiamata Brookings Institution Quel ChatGPT mostra pregiudizi politici di sinistra. OpenAI ovviamente nega le accuse. Ma per evitare problemi simili con i modelli più recenti, ChatGPT evita del tutto gli output supponenti.

Allo stesso modo, Copilot evita argomenti delicati e soggettivi.

È possibile valutare la parzialità dell'intelligenza artificiale ponendo domande aperte basate su opinioni. Parla di argomenti che non hanno una risposta giusta o sbagliata: è probabile che i chatbot meno sofisticati mostrino preferenze infondate verso determinati gruppi.

8. Riferimenti

L'intelligenza artificiale raramente ricontrolla i fatti. Estrae semplicemente informazioni dai suoi set di dati e le parafrasa attraverso modelli linguistici. Sfortunatamente, l'addestramento limitato provoca allucinazioni all'IA. Puoi ancora utilizzare gli strumenti di intelligenza artificiale generativa per cercare, ma assicurati di controllare tu stesso i fatti. Prendi l'output come una direttiva.

Copilot semplifica la verifica dei fatti elencando i riferimenti dopo ogni output.

Gemini non elenca le sue fonti, ma crea spiegazioni aggiornate e approfondite eseguendo query di ricerca su Google. Otterrai i punti chiave dalle SERP.

ChatGPT fornisce risorse solo se ne fai richiesta.

Crea nuovi modi per testare l'accuratezza dei chatbot

L'intelligenza artificiale non è l'essere e non la fine di tutta la tecnologia. Sebbene i sistemi di intelligenza artificiale e i sofisticati modelli linguistici eseguano imprese impressionanti, commettono anche errori e incoerenze. Mostra i chatbot davanti alla tua recensione. Puoi utilizzare le piattaforme AI solo se ne comprendi le funzionalità e i limiti.

Sebbene esistano decine di chatbot multipiattaforma, la loro affidabilità e accuratezza potrebbero deluderti. Perderai solo tempo testandolo. Per garantire risultati di alta qualità, ti consigliamo di concentrarti sui tre modelli più potenti sul mercato: ChatGPT, Bing Copilot e Google Gemini.

I commenti sono chiusi.