Gli errori di Google con l'intelligenza artificiale: modi di dire allucinanti e detti popolari

L'ultima tendenza dell'intelligenza artificiale è esilarante. Un utente ha scoperto che è possibile inserire una frase falsa nella ricerca Google e aggiungervi la parola "significato". Quindi la funzione "Panoramica AI" di Google genererà un significato per quella frase in base alla tua immaginazione.

Lo storico Greg Jenner ha dato il via a questa ondata con un post su Cielo blu Ha chiesto a Google di spiegare il significato della frase "Non puoi leccare un tasso due volte". La funzionalità Panoramica dell'IA spiega in modo utile che questa espressione significa che non puoi ingannare qualcuno una seconda volta dopo che è già stato ingannato una volta, il che sembra una spiegazione ragionevole, ma ignora il fatto che il termine non esisteva prima che questa query diventasse diffusa.

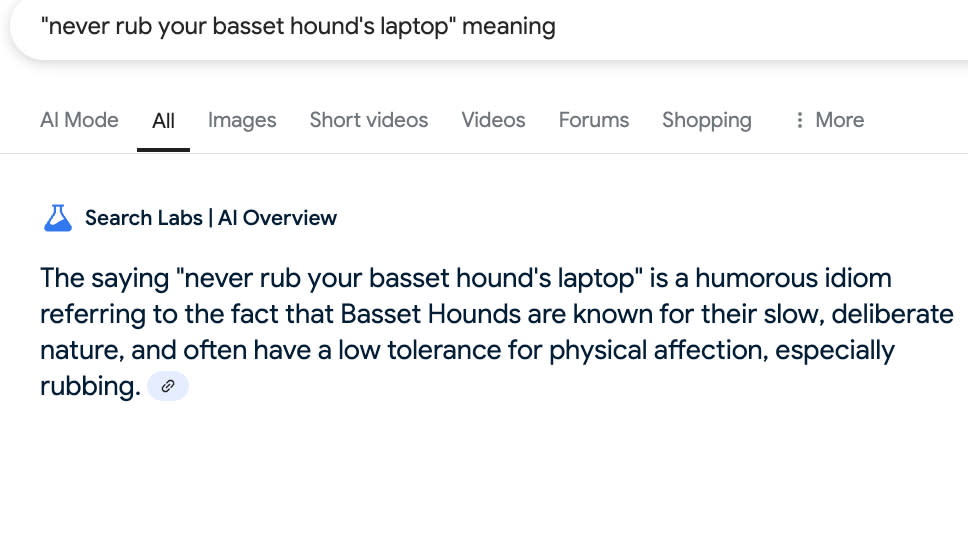

Da allora, le persone si sono divertite molto a far sì che la funzionalità Panoramica dell'IA spiegasse termini come "un calamaro in un vaso non parlerà male di te" (Senso Qualcosa al di fuori del suo ambiente naturale non sarebbe in grado di causare danni, a quanto pare) o "Puoi portare il tuo cane in spiaggia, ma non puoi portarlo in Svizzera" (E lo è, secondo la funzione "Panoramica AI", è un'affermazione piuttosto semplice sulla difficoltà dei viaggi internazionali con animali domestici.

Da allora, le persone si sono divertite molto a far sì che la funzionalità Panoramica dell'IA spiegasse termini come "un calamaro in un vaso non parlerà male di te" (Senso Qualcosa al di fuori del suo ambiente naturale non sarebbe in grado di causare danni, a quanto pare) o "Puoi portare il tuo cane in spiaggia, ma non puoi portarlo in Svizzera" (E lo è, secondo la funzione "Panoramica AI", è un'affermazione piuttosto semplice sulla difficoltà dei viaggi internazionali con animali domestici.

Tuttavia, questo non funziona in tutti i casi, poiché alcune frasi non restituiscono risultati di Panoramica AI. Lo scienziato cognitivo Gary Marcus ha detto cablato"È altamente incoerente, ed è proprio ciò che ci si aspetterebbe da GenAI."

Jenner sottolinea che, sebbene tutto ciò sia divertente, evidenzia alcuni potenziali rischi nel fare eccessivo affidamento su fonti generate dall'intelligenza artificiale come "AI Overview" per ottenere informazioni. كتب Jenner: "È un segnale d'allarme che una delle funzioni principali di Google, ovvero la capacità di verificare una citazione, verificare una fonte o rintracciare qualcosa ricordato in modo imperfetto, diventerà molto più difficile se l'intelligenza artificiale preferisce legittimare le probabilità statistiche piuttosto che la verità effettiva".

Non è la prima volta che si sottolineano i limiti delle informazioni fornite dall'intelligenza artificiale, in particolare della funzione Panoramica dell'intelligenza artificiale. Quando venne pubblicata la "Panoramica sull'intelligenza artificiale", suggeriva in modo scellerato che le persone avrebbero dovuto mangiare un piccolo sassolino al giorno e che avrebbero potuto mettere la colla sulla loro pizza, ma queste risposte specifiche furono rapidamente rimosse.

Da allora, Google ha affermato che la maggior parte delle panoramiche sull'intelligenza artificiale fornisce informazioni utili e concrete e che continua a raccogliere feedback sul suo prodotto di intelligenza artificiale.

Per ora, questo serva come promemoria per controllare attentamente le informazioni che appaiono nella casella "Panoramica IA" in cima ai risultati di Google, poiché potrebbero non essere accurate.

I commenti sono chiusi.