Microsoft lancia Phi-4: un modello di intelligenza artificiale super-inferenziale per competere con DeepSeek R1

Riepilogo:

- Microsoft ha lanciato i modelli di intelligenza artificiale inferenziale Phi-4, addestrati con 14 miliardi e 3.8 miliardi di parametri.

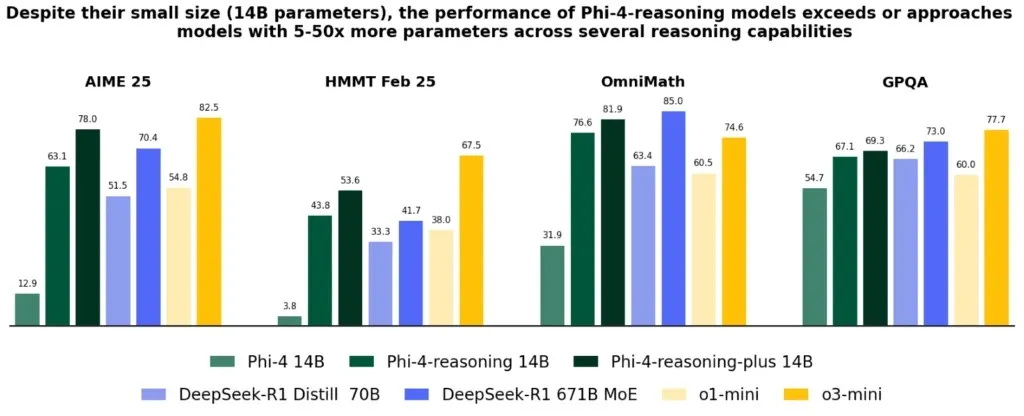

- Nonostante le dimensioni ridotte, i modelli di inferenza Phi-4 competono con modelli molto più grandi come DeepSeek R1 e o3-mini.

- Microsoft afferma che i modelli di inferenza Phi-4 possono essere eseguiti su PC con Windows Copilot+, grazie alle loro dimensioni ridotte.

Microsoft ha lanciato tre nuovi modelli di intelligenza artificiale deduttiva: Phi-4-reasoning, Phi-4-reasoning-plus e Phi-4-mini-reasoning. Si tratta di piccoli modelli linguistici, progettati per dispositivi terminali quali computer Windows e dispositivi mobili. Il modello di intelligenza artificiale basato sul ragionamento Phi-4 è addestrato con 14 miliardi di parametri e può eseguire attività di inferenza complesse.

Il modello Phi-4-reasoning-plus utilizza lo stesso modello di base, ma utilizza un calcolo aggiuntivo del tempo di inferenza, circa 1.5 volte il numero di token rispetto al Phi-4-reasoning, per fornire una maggiore accuratezza. Nonostante le dimensioni ridotte, i modelli Phi-4-reasoning sono competitivi con modelli più grandi come DeepSeek R1 671B e o3-mini.

Nello standard GPQA, il modello Phi-4-reasoning-plus-14B raggiunge un punteggio del 69.3% mentre il o3-mini 77.7%. Successivamente, nel test AIME 2025, il Phi-4-reasoning-plus-14B ottiene un punteggio del 78% e l'o3-mini ottiene un punteggio dell'82.5%. Prosegue dimostrando che il piccolo modello di Microsoft è molto vicino ai principali modelli di inferenza, che hanno dimensioni molto più grandi.

Microsoft afferma che i modelli di inferenza Phi-4 sono stati addestrati tramite una messa a punto supervisionata.Su dimostrazioni di inferenza attentamente curate da OpenAI o3-mini. Inoltre, Microsoft scrive: “Il modello dimostra che la formattazione accurata dei dati e i set di dati sintetici di alta qualità consentono ai modelli più piccoli di competere con i modelli più grandi.. "

A parte questo, il modello di ragionamento Phi-4-mini più piccolo, addestrato con soli 3.8 miliardi di parametri, supera in prestazioni molti modelli 7B e 8B. In benchmark quali AIME 24, MATH 500 e GPQA Diamond, il modello Phi-4-mini-reasoning-3.8B fornisce risultati competitivi, avvicinandosi molto a quelli dell'o1-mini. E' stato completato "RegolareModello Phi-4-miniUtilizzando accuratamente i dati sintetici generati dal modello Deepseek-R1. "

I modelli Phi di Microsoft sono già utilizzati in modo nativo sui computer Windows. Copilota+ PCTrae vantaggio dall'unità di elaborazione neurale integrata. Sarà interessante vedere come i modelli di inferenza Phi-4 miglioreranno le prestazioni dell'intelligenza artificiale sui dispositivi.

I commenti sono chiusi.