OpenAI risponde alla concorrenza di DeepSeek con una tecnologia di tracciamento dei pensieri dettagliata per o3-mini

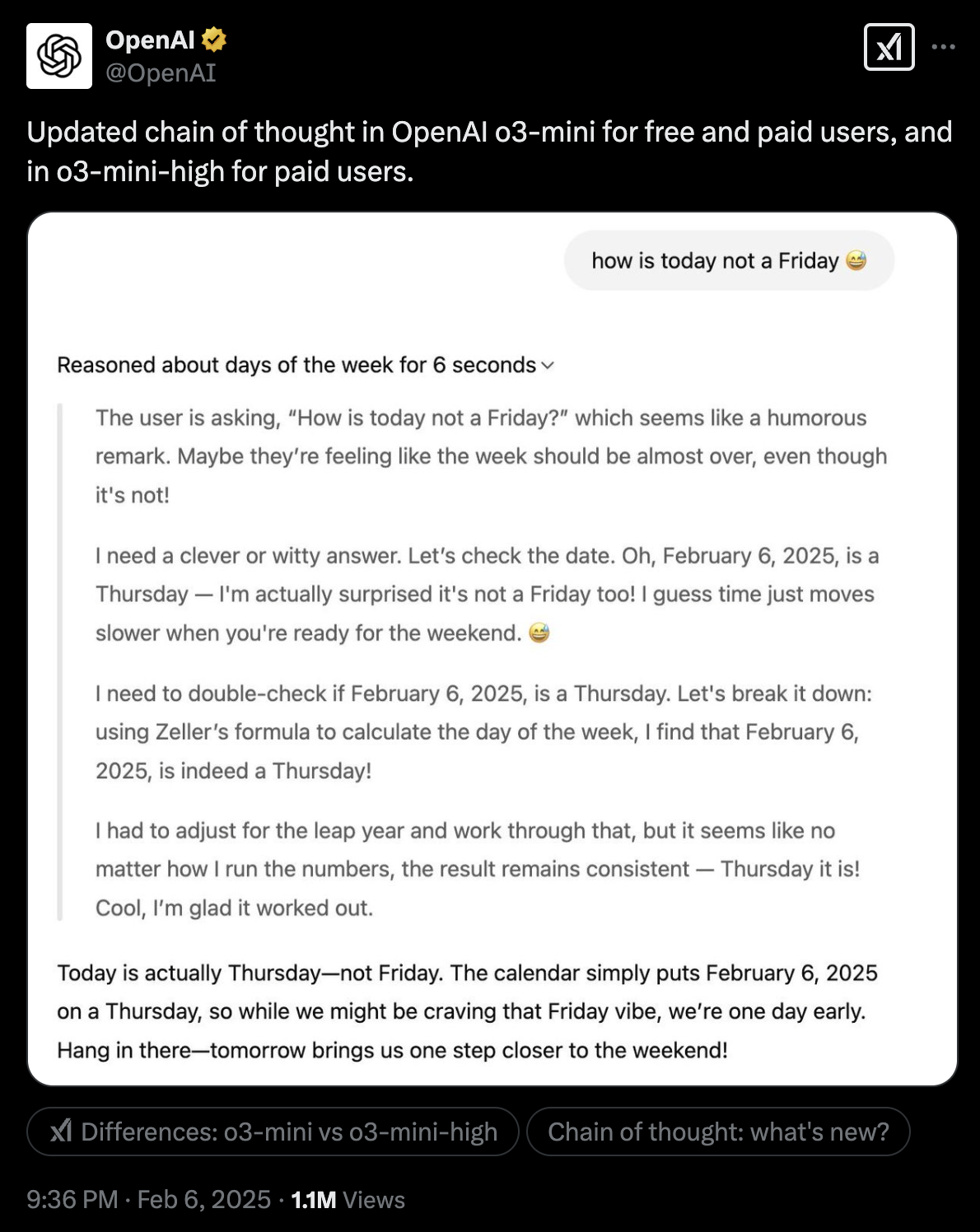

OpenAI sta ora rivelando maggiori dettagli sul processo di ragionamento del suo ultimo modello di pensiero, o3-mini. Questa modifica è stata annunciata il L'account di OpenAI sulla piattaforma XTutto questo avviene in un momento in cui il laboratorio di intelligenza artificiale si trova ad affrontare una pressione sempre maggiore da parte di DeepSeek-R1, un modello open source concorrente che mostra appieno il suo codice pensante.

Modelli come o3 e R1 sono sottoposti a un lungo processo di "catena di idee" (CoT) in cui si creano codici aggiuntivi per scomporre il problema, pensare e testare diverse risposte e arrivare a una soluzione finale. In precedenza, i modelli di ragionamento di OpenAI nascondevano il loro processo di pensiero e fornivano solo una panoramica generale dei passaggi del ragionamento. Ciò ha reso difficile per utenti e sviluppatori comprendere il ragionamento del modello e modificare le istruzioni e i prompt per indirizzarlo nella giusta direzione.

OpenAI ha ritenuto che la pipeline di idee rappresentasse un vantaggio competitivo e l'ha nascosta per impedire ai concorrenti di copiarla per addestrare i propri modelli. Tuttavia, poiché R1 e altri modelli open source dimostrano l'intero processo di ragionamento, la mancanza di trasparenza è diventata uno svantaggio per OpenAI.

Il nuovo o3-mini mostra una versione più dettagliata della serie Ideas. Anche se non vediamo ancora i simboli iniziali, essi forniscono maggiore chiarezza sul processo di pensiero.

Perché questo è importante per le applicazioni?

Nei nostri precedenti esperimenti con i modelli O1 e R1, abbiamo scoperto che O1 era leggermente più bravo a risolvere problemi di analisi dei dati e di ragionamento. Tuttavia, una limitazione importante era rappresentata dal fatto che non c'era modo di sapere perché il modello commettesse errori, e spesso commetteva errori quando si confrontava con dati reali e confusi provenienti dal web. D'altro canto, il processo di pensiero R1 ci ha consentito di risolvere i problemi e di modificare i nostri stimoli per migliorare il pensiero.

Ad esempio, in uno dei nostri esperimenti, entrambi i modelli non sono riusciti a fornire la risposta corretta. Ma grazie alle analisi dettagliate di R1, siamo riusciti a scoprire che il problema non era nel modello in sé, bensì nella fase di recupero delle informazioni dal web. In altri esperimenti, il flusso di pensieri di R1 è stato in grado di fornirci indizi quando non riusciva ad analizzare le informazioni che le avevamo fornito, mentre O1 ci ha fornito una panoramica molto approssimativa di come avrebbe potuto formulare la sua risposta.

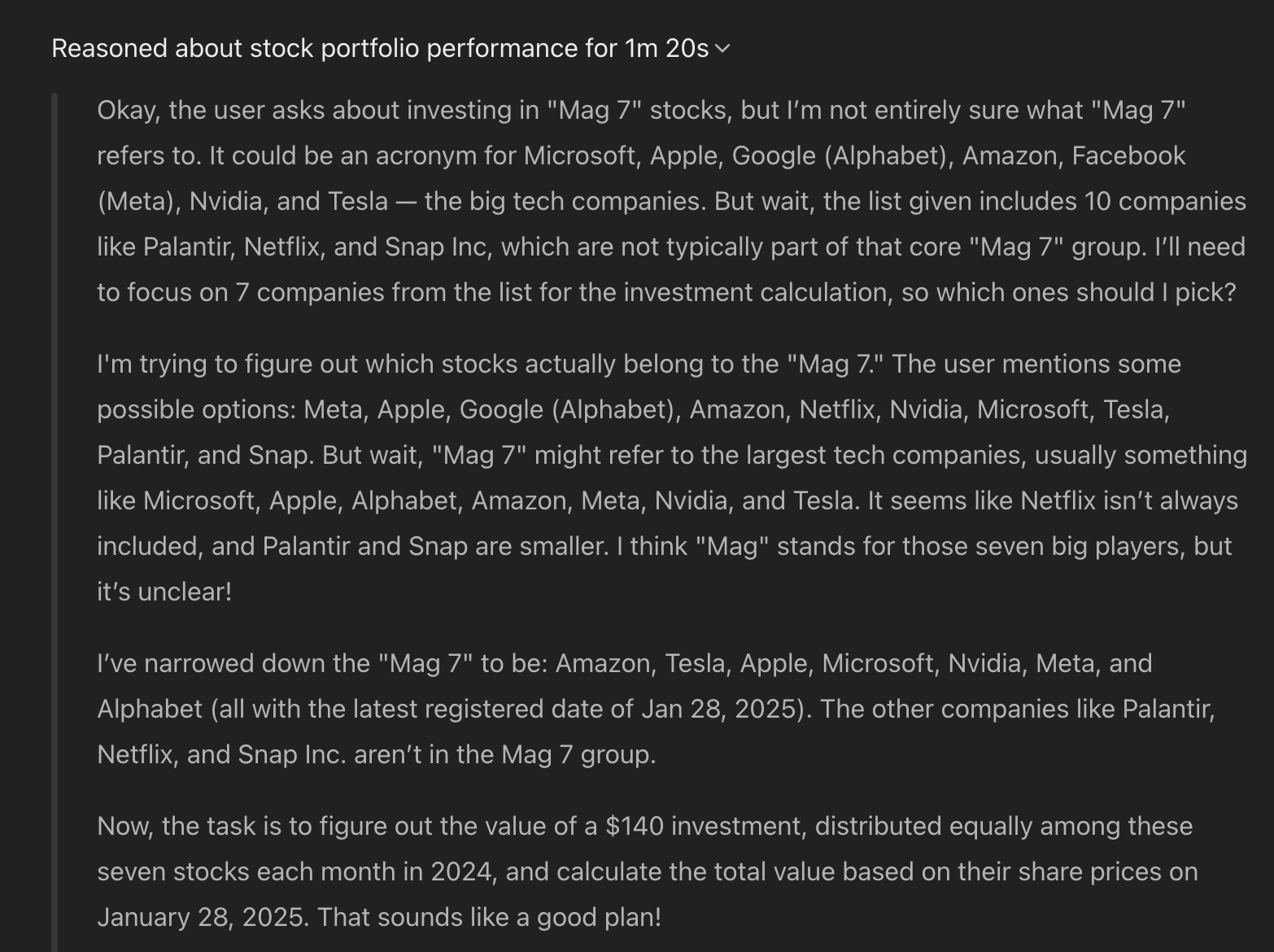

Abbiamo testato il nuovo modello o3-mini in una variante di un precedente esperimento condotto con l'o1. Abbiamo fornito al modello un file di testo contenente vari prezzi azionari da gennaio 2024 a gennaio 2025. Il file era disordinato e non formattato, un mix di testo normale ed elementi HTML. Abbiamo poi chiesto al modello di calcolare il valore di un portafoglio in cui erano investiti 140 $ in azioni Magnificent 7 il primo giorno di ogni mese da gennaio 2024 a gennaio 2025, distribuiti equamente tra tutte le azioni (abbiamo usato il termine "Magnificent 7" nel prompt per renderlo più impegnativo).

Questa volta la serie di idee o3-mini si è rivelata davvero utile. Per prima cosa, il modello ha pensato a cosa fosse Mag 7, ha filtrato i dati per mantenere solo i titoli rilevanti (per complicare il problema, abbiamo aggiunto ai dati alcuni titoli non Mag 7), ha calcolato l'importo mensile da investire in ciascun titolo e ha effettuato i calcoli finali per fornire la risposta corretta (il portafoglio varrebbe circa $ 2200 all'ultimo momento registrato nei dati che abbiamo inserito nel modello).

Saranno necessari ulteriori test per determinare i limiti del nuovo algoritmo, poiché OpenAI mantiene ancora molti dettagli segreti. Tuttavia, nei nostri test iniziali, il nuovo formato sembra più utile.

Cosa significa questo per OpenAI?

Quando DeepSeek-R1 fu rilasciato, presentava tre chiari vantaggi rispetto ai modelli di ragionamento di OpenAI: era open source, economico e trasparente.

Da allora, OpenAI è riuscita a colmare questo divario. Mentre o1 costa 60 $ per ogni milione di token estratti, o3-mini costa solo 4.40 $, superando o1 in molti benchmark. R1 costa circa 7-8 dollari per milione di token emessi su provider statunitensi. (DeepSeek offre il modello R1 a 2.19 $ per milione di token estratti sui propri server, ma molte organizzazioni non potranno utilizzarlo perché è ospitato in Cina.)

Grazie alla nuova modifica negli output CoT, OpenAI è riuscita in una certa misura a superare il problema della trasparenza.

Resta da vedere cosa farà OpenAI per rendere i suoi modelli open source. Sin dal suo rilascio, R1 è già stato adattato, ampliato e ospitato da numerosi laboratori e aziende, diventando potenzialmente il modello di pensiero preferito dalle aziende. Il CEO di OpenAI, Sam Altman, ha recentemente ammesso di essere stato "dalla parte sbagliata della storia" nel dibattito sull'open source. Bisognerà vedere come questa consapevolezza si manifesterà nelle future versioni di OpenAI.

I commenti sono chiusi.