Modelli di intelligenza artificiale: capacità straordinarie, ma carenti nel settore dei videogiochi

Con la continua evoluzione degli strumenti di intelligenza artificiale, siamo costantemente incoraggiati a delegare loro compiti complessi. I modelli linguistici di grandi dimensioni possonoLLM) Scrivere e-mail, creare presentazioni, progettare applicazioni, creare video, cercare su Internet e riassumere i risultati, e molto altro ancora. Tuttavia, c'è una cosa con cui ho ancora grandi difficoltà: i videogiochi.

Finora quest'anno, due delle più grandi aziende di intelligenza artificiale (Microsoft e Anthropic) hanno provato a far sì che i loro modelli creassero o giocassero a giochi, ma i risultati sono stati probabilmente molto più limitati di quanto molti si aspettino. Ciò evidenzia le attuali sfide dell'intelligenza artificiale generativa, soprattutto in attività che richiedono una pianificazione strategica a lungo termine e un processo decisionale complesso.

Ciò li rende dimostrazioni perfette di cosa l'intelligenza artificiale generativa stia realmente facendo oggi: in breve: può fare molto di più di prima, ma non può fare tutto. Ciò dimostra che l'intelligenza artificiale generativa è ancora in una fase di sviluppo e che, nonostante le sue crescenti capacità, presenta ancora dei limiti in alcuni ambiti.

Microsoft produce Quake II con intelligenza artificiale

La produzione di videogiochi si trova ad affrontare sfide simili a quelle che si riscontrano nella produzione video, dove il movimento risulta strano e distorto e l'intelligenza artificiale inizia a perdere il contatto con la "realtà" dopo un certo periodo di tempo. L'ultimo tentativo di Microsoft, che Chiunque può provarlo.È una versione generata dall'intelligenza artificiale di Quake II.

Ho giocato a questo gioco diverse volte ed è un'esperienza davvero strana, con nemici disorientanti che compaiono dal nulla e l'ambiente circostante che cambia man mano che ti muovi. Spesso, quando entravo in una nuova stanza, la porta spariva quando mi giravo e, quando guardavo di nuovo davanti a me, le pareti si erano spostate.

L'esperienza dura solo pochi minuti prima di interrompersi e di invitarti a iniziare una nuova partita. Tuttavia, se sei sfortunato, il gioco potrebbe smettere di rispondere correttamente ai tuoi input anche prima.

In ogni caso è una bellissima esperienza e credo che sarebbe utile che più persone la vedessero. Ti consente di sperimentare in prima persona i vantaggi dell'intelligenza artificiale generativa e quali sono i suoi attuali limiti. Anche se è impressionante il fatto che siamo riusciti a creare un'esperienza di videogioco interattiva, è difficile immaginare che qualcuno possa giocare a questa demo tecnologica e credere che il prossimo Assassin's Creed sarà prodotto dall'intelligenza artificiale.

Tuttavia, questo tipo di idee e supposizioni esistono, soprattutto perché oggi le persone non possono fare a meno di sentir parlare di intelligenza artificiale. Anche se non ti interessa affatto l'intelligenza artificiale, ti verrà imposta ovunque tu vada. Il problema è che le informazioni che riceve la persona media sono costituite quasi interamente da commenti di marketing di grandi aziende tecnologiche e da commenti di dirigenti ripresi dalle pubblicazioni di notizie.

Ciò significa che sentono affermazioni esagerate e contraddittorie come queste:

Ha il potenziale per risolvere alcuni dei più grandi problemi del mondo, come il cambiamento climatico, la povertà e le malattie. (ل)

È probabile che nel 2025 noi di Meta, così come altre aziende che lavorano principalmente su questo argomento, disporremo di un'intelligenza artificiale in grado di svolgere il ruolo di ingegnere di medio livello nella vostra azienda e di scrivere codice in modo efficiente. (Mark Zuckerberg)

L'uso efficace dell'intelligenza artificiale è ormai un'aspettativa di base per tutti coloro che lavorano in Shopify. Oggi è uno strumento utilizzato da tutte le professioni e con il passare del tempo diventerà sempre più importante. Francamente, non credo sia possibile evitare di apprendere le competenze necessarie per applicare l'intelligenza artificiale nella propria attività. (Toby Lutke, CEO di Shopify)

Ora siamo certi di sapere come realizzare l'intelligenza artificiale generale (AGI) così come l'abbiamo tradizionalmente intesa. Riteniamo che nel 2025 potremmo vedere i primi agenti di intelligenza artificiale "entrare nel mondo del lavoro" e cambiare radicalmente il modo in cui le aziende producono. (Sam Altman, CEO di OpenAI)

L'intelligenza artificiale è più pericolosa, ad esempio, di una progettazione aeronautica mal gestita, di una scarsa manutenzione della produzione o di una produzione automobilistica scadente, nel senso che ha il potenziale – per quanto piccolo, ma non banale – di distruggere la civiltà. (Elon Musk)

Tutto ciò sembra un po' troppo, non è vero? Dovrebbe salvarci e distruggerci allo stesso tempo, essere sia uno strumento per i professionisti sia uno strumento che li sostituirà, e sembra che potremmo ottenere un'intelligenza artificiale di livello fantascientifico già quest'anno. Quando la gente sente tutto questo, inizia ad aspettarsi cose fantastiche da questi gadget e pensa che tutti gli impiegati passino le giornate a parlare ai loro computer come i personaggi di Star Trek.

Tuttavia, la realtà non è questa. La realtà assomiglia a Quake II: tremolante e sfocata, con forme dei nemici incomprensibili. I modelli LLM di livello ChatGPT hanno già rappresentato una svolta entusiasmante nel 2022 e sono stati molto divertenti per tutti, ma per la maggior parte degli utilizzi che le grandi aziende tecnologiche ci stanno proponendo ora, l'intelligenza artificiale semplicemente non è abbastanza potente. I livelli di accuratezza sono molto bassi, le capacità di seguire le istruzioni sono molto scarse, gli intervalli di contesto sono molto ristretti e l'addestramento si basa solo su concetti incomprensibili di Internet e non su conoscenze del mondo reale.

Ma creare un videogioco è un obiettivo estremamente complesso: dopotutto, ci vogliono anni e anni perché interi team di persone realizzino queste cose. Che ne dici invece di giocare ai videogiochi?

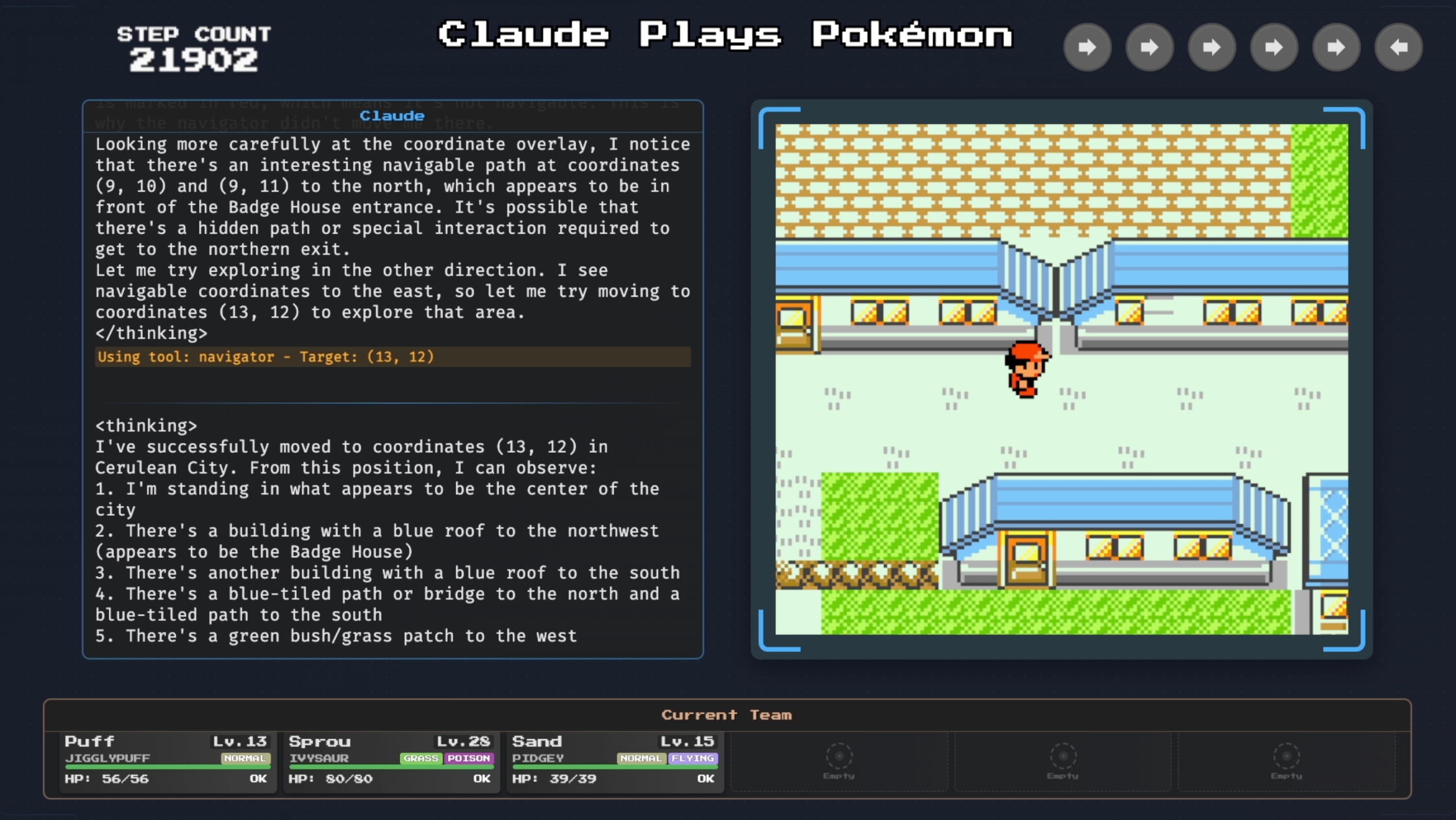

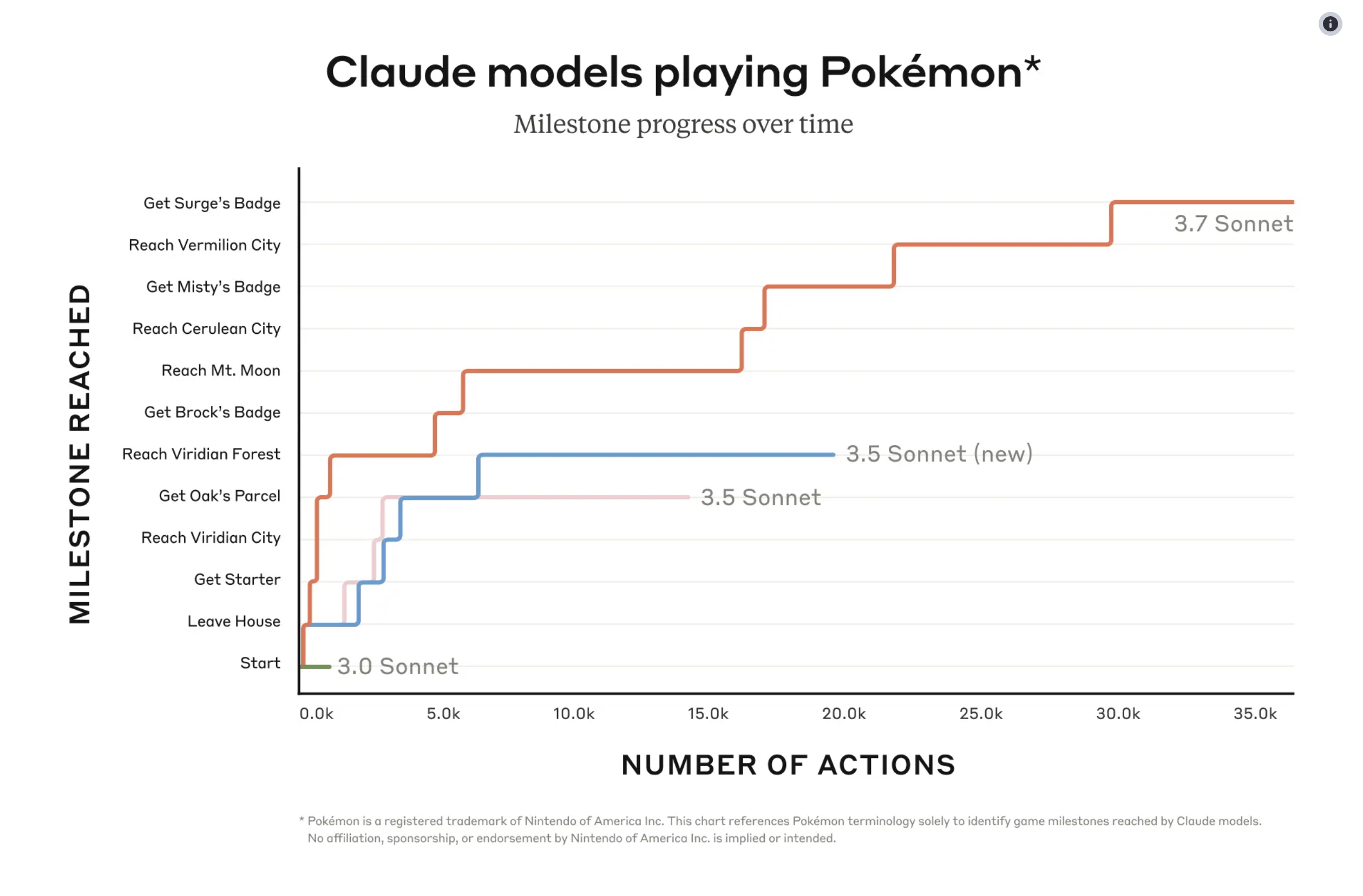

Claude "gioca" a Pokémon Rosso

Ebbene, pare che anche in questo ambito si stiano facendo esperimenti. L'ultimo modello di Anthropic, che è Claude 3.7 Sonetto , Lui suona Pokémon Rosso su Twitch È in circolazione da circa due mesi e sta ottenendo i risultati migliori che un modello linguistico di grandi dimensioni (LLM) abbia mai ottenuto nel gioco Pokémon. C'è però un piccolo appunto: è ancora molto indietro rispetto al livello medio di un bambino di 10 anni.

Un problema è la velocità: Claude compie migliaia di azioni nell'arco di diversi giorni per fare cose come attraversare la Foresta Viridian. Ciò riflette le sfide dell'intelligenza artificiale nella gestione di compiti complessi.

Perché ci vuole così tanto tempo? Non è che non riesca a capire come vincere strategicamente le battaglie Pokémon: è proprio questa la parte in cui è bravo. D'altro canto, muoversi nell'ambiente ed evitare alberi ed edifici non è una bella cosa. Claude non è mai stato addestrato a giocare a Pokémon e per lui non è facile comprendere la pixel art e ciò che rappresenta. Queste difficoltà evidenziano il divario tra la capacità di elaborare dati e la capacità di interagire con ambienti complessi.

Per lui è particolarmente difficile attraversare zone labirintiche come il Monte Luna, poiché ha difficoltà a tracciare una mappa della zona ed evitare di essere ripercorso. Una volta, rimase così bloccato in un angolo che concluse che il gioco era rotto e inviò una richiesta ufficiale per ripristinarlo. Ciò dimostra come l'intelligenza artificiale, nonostante le sue capacità avanzate, non abbia ancora la comprensione intuitiva di cui godono gli esseri umani.

Anche questi primi tentativi non furono privi di momenti divertenti.

Una volta, Claude si ritrovò bloccato in un angolo e, convinto che qualcosa non andasse, scrisse una richiesta formale per resettare il gioco. pic.twitter.com/5RIiCJdxCM— Antropico (@AnthropicAI) 25 Febbraio 2025

Inoltre, non è bravo a ricordare i suoi obiettivi, le cose che ha già provato o i luoghi che ha già visitato.

C'è una ragione molto semplice per questo: i modelli linguistici di grandi dimensioni (LLM) hanno una "finestra di contesto" limitata che funge da memoria. Possono contenere solo una certa quantità di informazioni e, una volta raggiunto il limite, Claude comprime ciò che ha per fare spazio a più informazioni. Quindi, un'informazione come "visitato Viridian City, entrato in ogni edificio e parlato con ogni PNG" potrebbe essere compressa semplicemente in "visitato Viridian City", spingendo Claude a tornare indietro e controllare se c'è qualcosa di Plus da fare in città.

In breve: Claude non riesce a capire dove sta andando, sbatte contro i muri, viene confuso da oggetti casuali e PNG, dimentica dove è stato e cosa sta cercando di fare e ogni decisione che prende richiede paragrafi e paragrafi di pensiero. Questa non è una critica: si tratta di esperimenti entusiasmanti che spingono i grandi modelli linguistici (LLM) ai limiti del possibile.

Ma con tutto questo clamore che circonda l'intelligenza artificiale, è importante che le persone vedano dimostrazioni come questa e si facciano una propria opinione sull'intelligenza artificiale. Alcune persone cercano di venderci l'idea che stiamo per raggiungere il picco di intelligenza, che entro pochi anni l'intelligenza artificiale (IA) supererà persino gli esseri umani più intelligenti, ma non credo che siano onesti: sono solo venditori. Siamo ben lontani dall'apice, tutto questo è appena iniziato.

I commenti sono chiusi.