Come installare localmente gli ultimi Large Language Model (LLM) su un Mac

Negli ultimi anni, i Large Language Model (LLM) sono diventati sempre più popolari grazie alla loro capacità di generare testo simile a quello umano e di supportare diverse attività. Non tutti i modelli sono open source, ma quasi tutte le principali aziende tecnologiche ne hanno una versione scaricabile ed eseguibile dagli utenti.

Eseguire questi modelli localmente sul tuo Mac può essere vantaggioso sia per motivi di privacy che di costi. In questo articolo, esploreremo come installare ed eseguire LLM utilizzando OllamaSi tratta di uno strumento potente per sviluppatori e utenti alle prime armi. Parleremo di alcuni strumenti dell'interfaccia utente grafica che possono semplificare il processo per coloro che preferiscono non utilizzare il Terminale di macOS.

In questo modo, puoi accedere ai più recenti modelli di testo basati sull'intelligenza artificiale di [Google], [Microsoft], [Meta] e altre aziende di intelligenza artificiale come [Mistral] e [DeepSeek].

Capire gli LLM: cosa significano i parametri?

Prima di addentrarci nel processo di installazione, chiariamo cosa sono numeri come "7B"O"14BQuando si fa riferimento agli LLM, questi numeri rappresentano la dimensione del modello in termini di gli insegnanti (In miliardi), che sono essenzialmente "maniglie e interruttori" che vengono regolati con precisione durante l'allenamento.

Un numero maggiore di parametri consente al modello di catturare pattern e relazioni più complessi nel linguaggio, con il potenziale vantaggio di migliorare le prestazioni. Tuttavia, è importante notare che avere più parametri non garantisce sempre risultati migliori; anche la qualità dei dati di training e le risorse computazionali a disposizione del modello giocano un ruolo significativo.

Requisiti di sistema

Dovrai assicurarti che il tuo [Mac] abbia almeno le seguenti specifiche:

- macOS 10.15 o successivo (consigliato macOS 13 o successivo)

- Almeno 8 GB di RAM (consigliati 16 GB o più)

- 10 GB di spazio di archiviazione libero (il minimo richiesto per i modelli più piccoli; i modelli più avanzati con un numero massimo di parametri richiedono circa 700 GB)

- Processore multi-core [Intel] o processore [Apple Silicon] (preferibilmente M2 o superiore)

Installa Ollama

Ollama È uno strumento open source che consente di eseguire LLM direttamente sul computer locale. Ecco come iniziare:

- Scarica Ollama: Visita il sito web Ollama Scarica la versione per macOS. Puoi anche usare [Homebrew] per installarla eseguendo

brew install ollamaNel tuo Terminale.

- Installa OllamaSe hai scaricato il programma di installazione, fai doppio clic su di esso e segui la procedura guidata. Se utilizzi Homebrew, vai al passaggio 4.

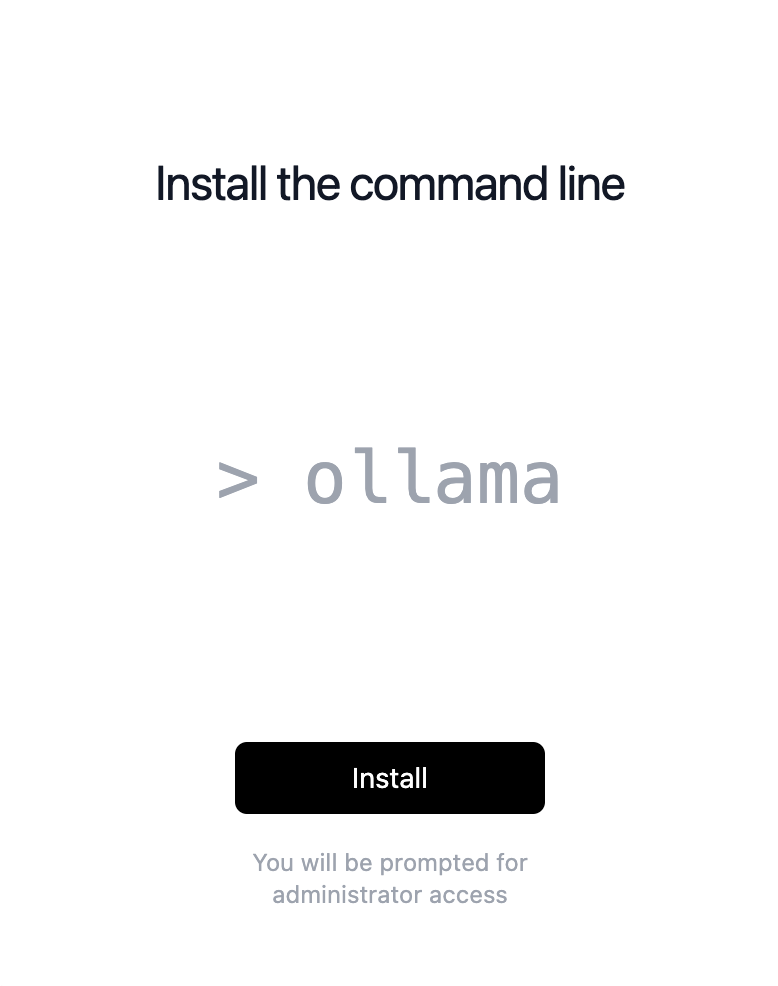

- Il passo successivo per l'installatore è semplicemente cliccare sul pulsante. InstallazioniTi verrà richiesta la password di amministratore.

- Corri OllamaApri una finestra del terminale e avvia Ollama come servizio utilizzando il comando

brew services start ollamaQuesto renderà Ollama disponibile all'indirizzohttp://localhost:11434/. - Scarica ed esegui il modelloUtilizzare il comando

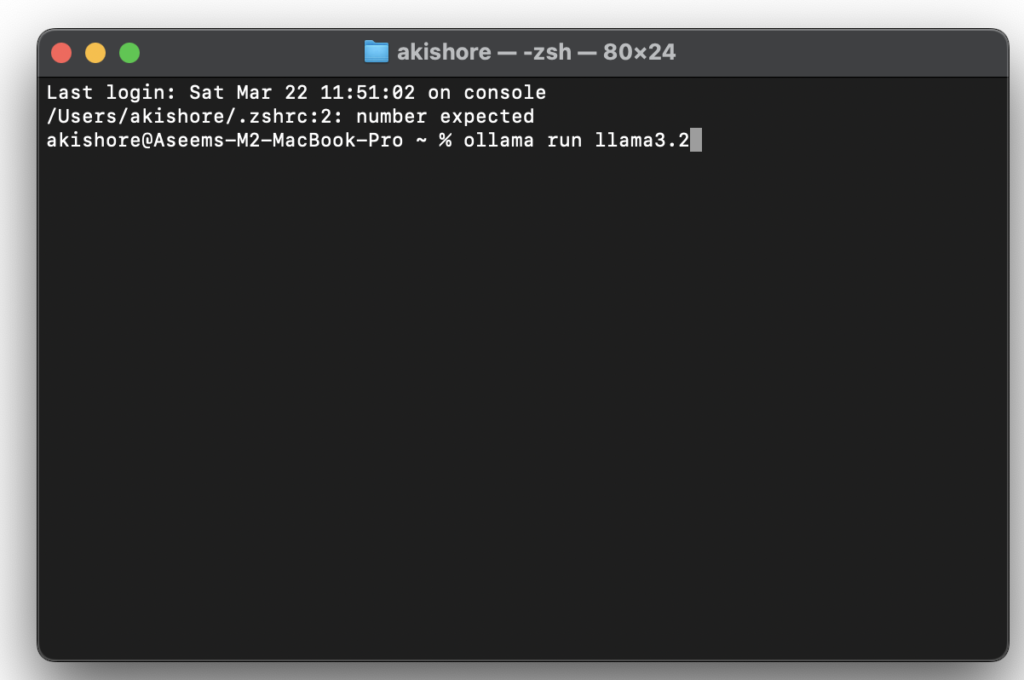

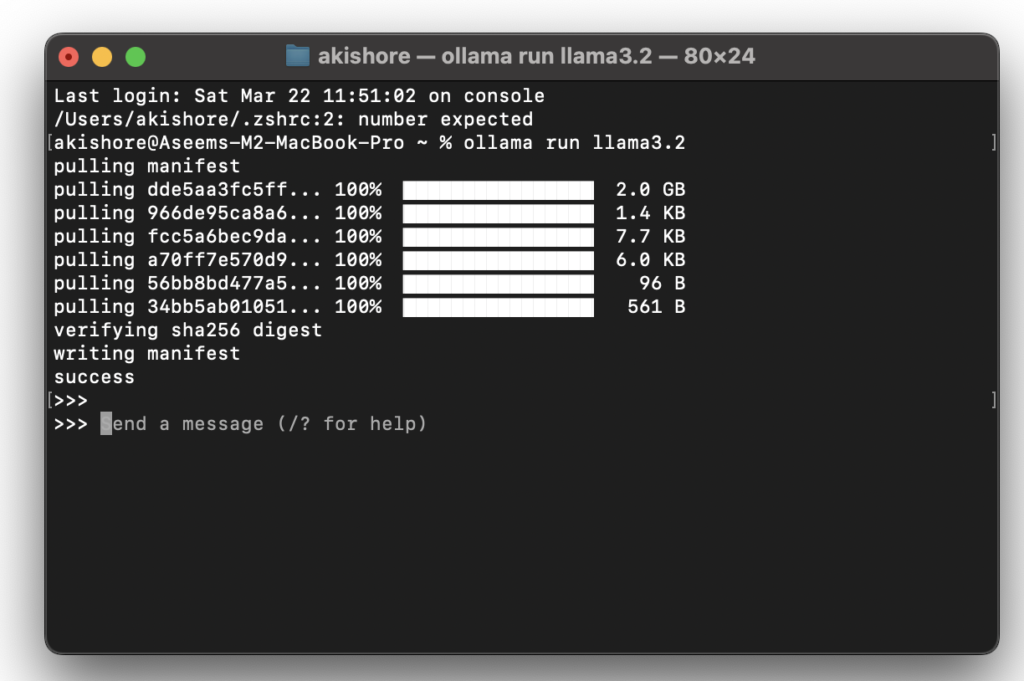

ollama pull <model-name>Per scaricare un modello, quindi il comandoollama run <model-name>Per eseguirlo. Ad esempio, per eseguire un modello DeepSeek-R1, usa il comandoollama pull deepseek-r1Seguito dall'ordineollama run deepseek-r1. - Per scaricare una versione più grande del modello, basta aggiungere due punti verticali seguiti dalla dimensione. Ad esempio, per scaricare un modello 14B DeepSeekUtilizzerai il comando ollama esegue deepseek-r1:14bSul sito web di Ollama puoi cliccare su uno qualsiasi dei moduli e ti verranno mostrati tutti i diversi comandi per ogni versione.

Puoi trovare l'elenco completo di Modelli Ollama Qui. Puoi anche usare il secondo comando come descritto sopra e, se non è già installato, prima estrarrà il modulo e poi lo eseguirà.

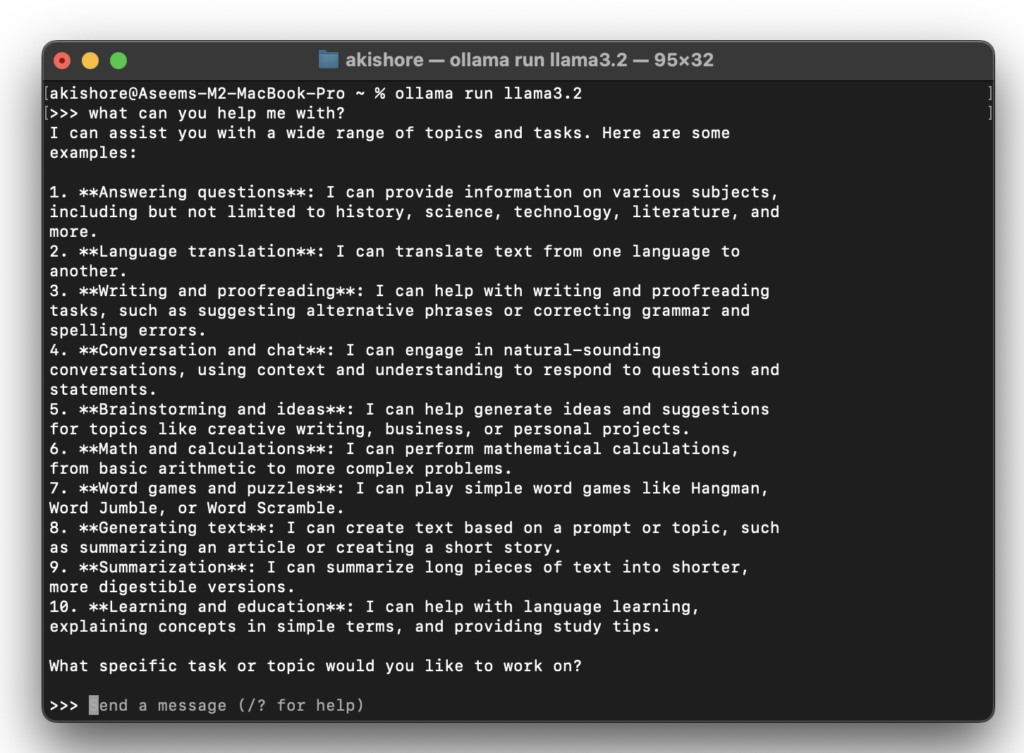

Ora che vedi le tre frecce ad angolo retto (>>>), puoi iniziare a digitare i comandi nel modulo.

Ecco fatto! Ora puoi interagire localmente con il tuo LLM in intelligenza artificiale senza preoccuparti di costi, sovrautilizzo o che altri possano leggere ciò che scrivi. Questa è la soluzione ideale se hai argomenti delicati o personali che vorresti discutere con un LLM in intelligenza artificiale, ma non vuoi che una grande azienda tecnologica legga i tuoi pensieri.

Utilizzo di strumenti di interfaccia utente grafica con Ollama

Sebbene Ollama sia potente ed efficiente per gli sviluppatori, alcuni utenti potrebbero preferire un'interfaccia utente grafica (GUI) per interagire con gli LLM. Ecco alcuni strumenti che possono fornire un'interfaccia utente grafica per Ollama:

-

-

- Interfaccia grafica utente di OllamaSi tratta di un'applicazione gratuita e open source per utenti macOS, sviluppata utilizzando SwiftUI. Offre un'interfaccia accattivante ed è un'ottima opzione per chi desidera accedere ai moduli LLM in locale senza utilizzare un terminale.

- Interfaccia utente di OllamaUn'interfaccia utente web semplice, basata su HTML, che consente di definire e interagire con i moduli direttamente nel browser. Include anche un'estensione per Chrome per un facile accesso.

- Chatbox AIQuesta è l'opzione più semplice per i principianti e spiegherò come utilizzarla di seguito. Nota che non è necessario sottoscrivere il servizio Chatbox AI, che è un abbonamento offerto da loro, così puoi accedere a tutti i modelli LLM senza dover installare Ollama.

-

Per utilizzare la migliore interfaccia AI di Chatbox, vai su pagina di download Ottieni la versione per il tuo Mac.

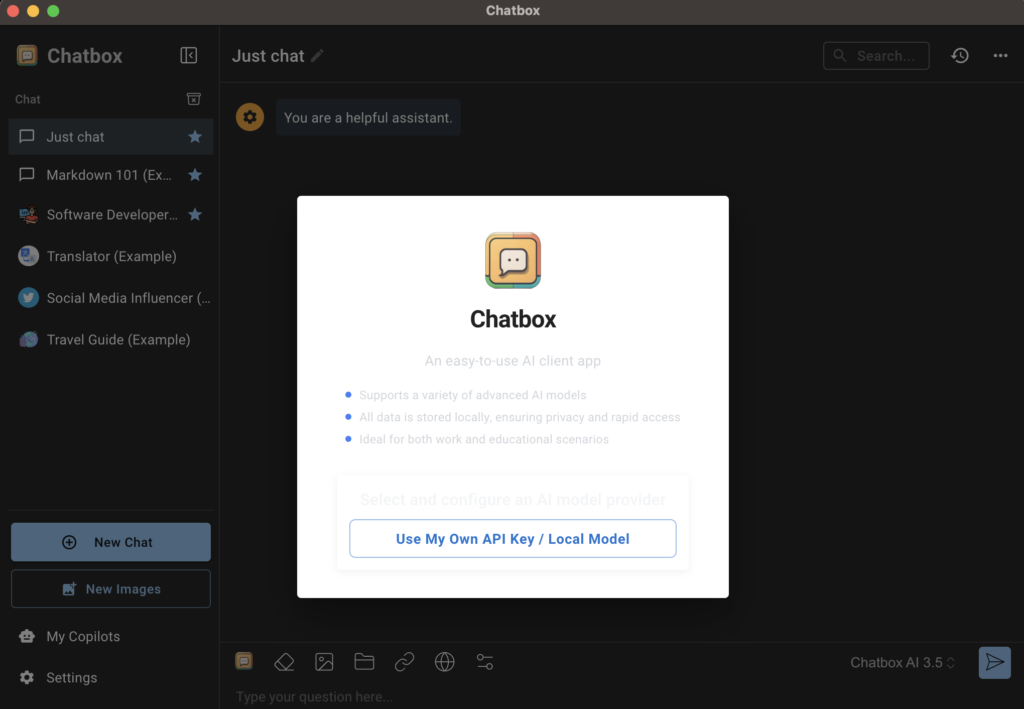

Quindi, apri il programma di installazione ed eseguilo. Nella prima schermata, apparirà una finestra pop-up che ti chiederà come utilizzare Chatbox AI.

Dovrai cliccare sul pulsante Utilizza la mia chiave API / modello locale.

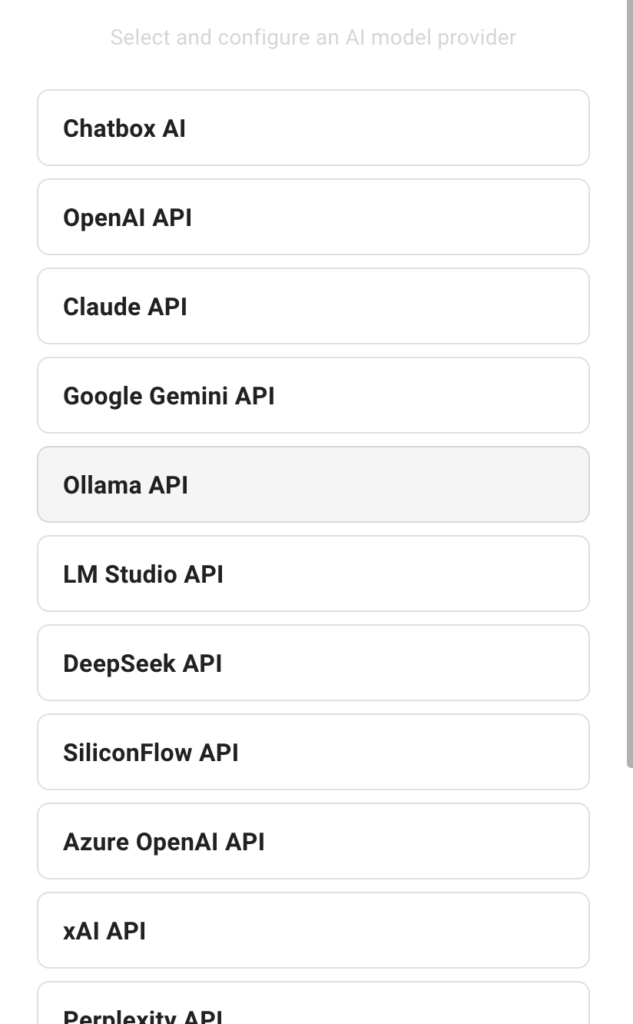

Quindi, tocca API di Ollama Come fornitore di modelli di intelligenza artificiale.

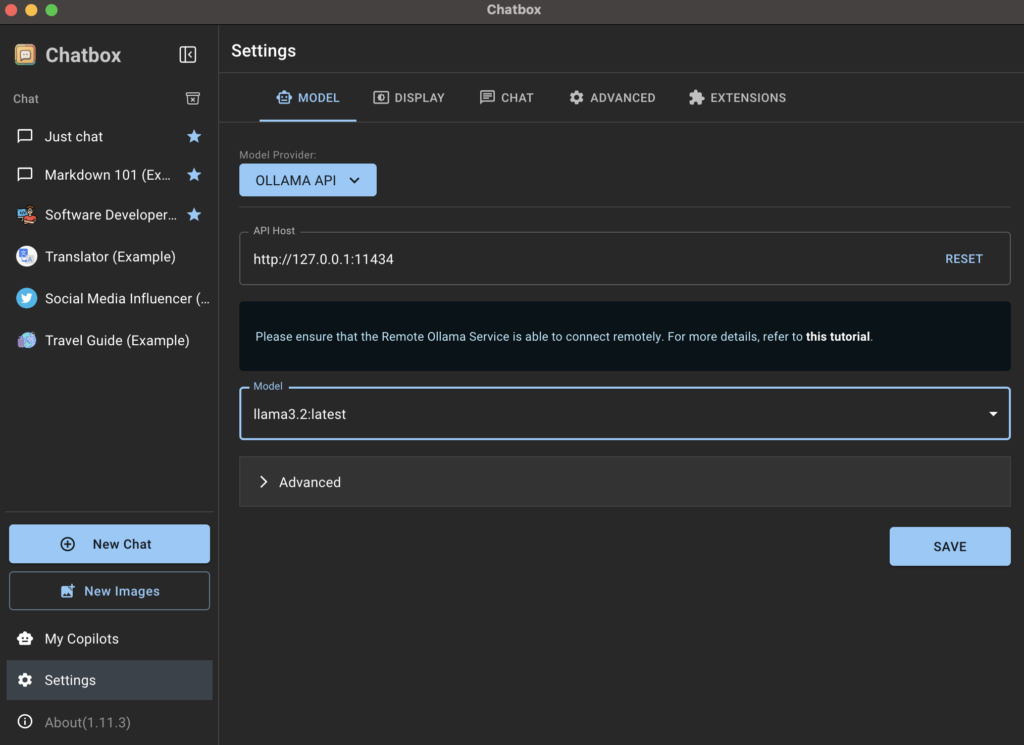

Chatbox AI dovrebbe rilevare automaticamente che Ollama è in esecuzione e impostare l'host API sul suo valore predefinito, che è Indirizzo IP di ritorno del ciclo e numero di porta 11434Non è necessario apportare modifiche. All'interno del modulo, dovresti vedere i moduli precedentemente installati tramite Terminale. Nel mio caso, è il modulo lama 3.2.

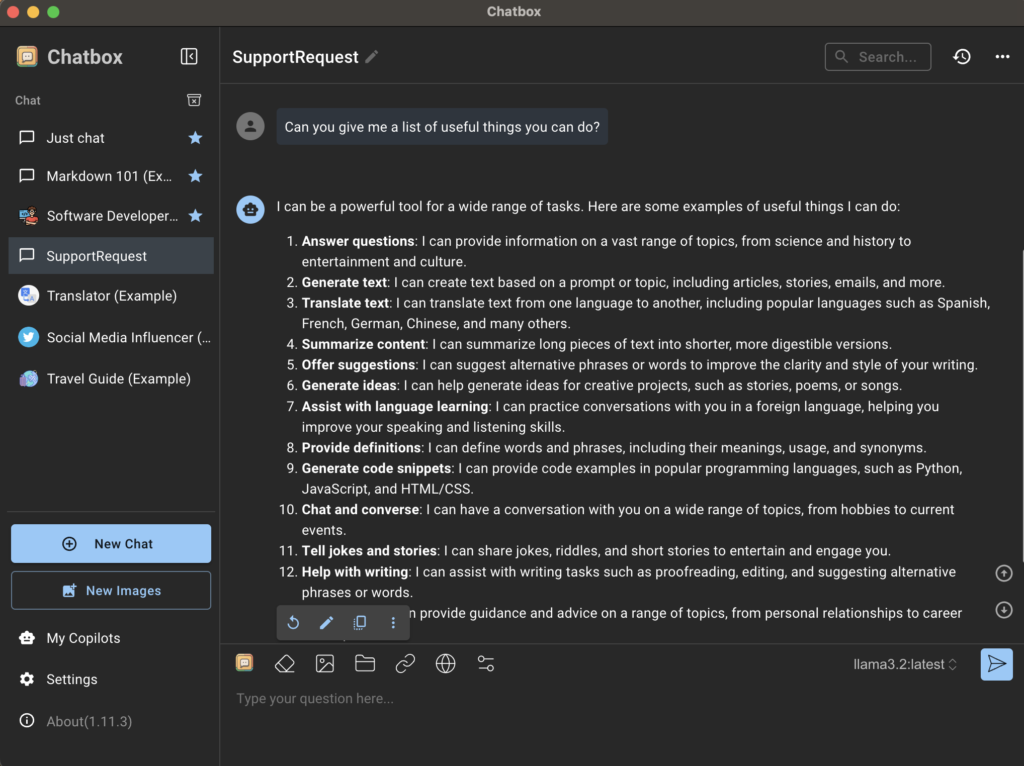

Tornando alla home page dell'app, clicca su Solo chat O Nuova chat Assicurati di selezionare il modello corretto in basso a destra. Puoi cambiare modello in qualsiasi momento, ma ti consiglio di creare una nuova chat per ogni modello che utilizzi, in modo da poter vedere facilmente le differenze.

Strumenti alternativi per l'esecuzione locale di modelli LLM

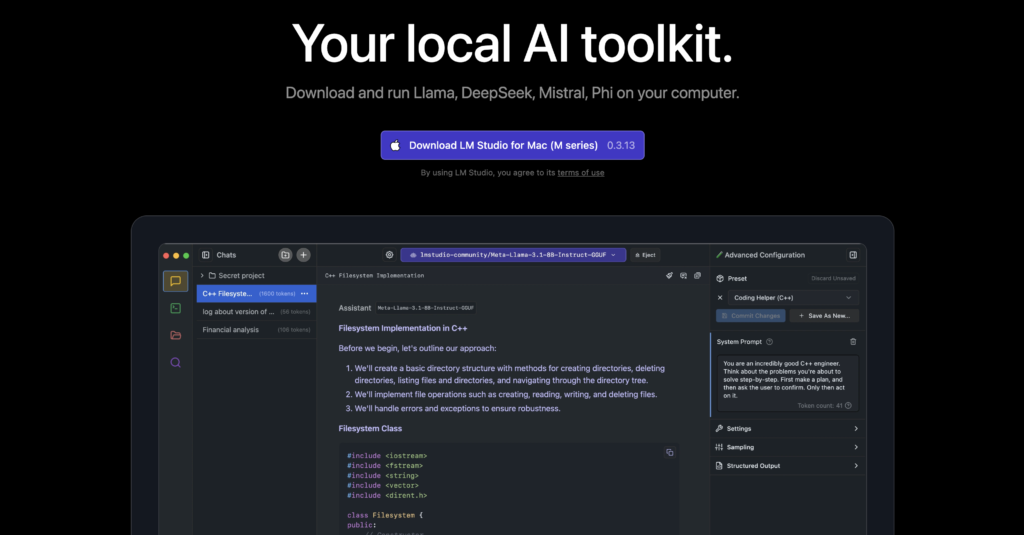

Se stai cercando alternative a Ollama o preferisci un'esperienza più intuitiva fin dall'inizio, allora Studio LM È un'altra ottima opzione. Offre un'interfaccia intuitiva per esplorare e utilizzare vari modelli di intelligenza artificiale, consentendo di scaricarli ed eseguirli facilmente. LM Studio è disponibile per Linux, Mac e Windows e offre funzionalità come la personalizzazione dei parametri del modello e della cronologia delle chat. Attualmente è gratuito, motivo per cui lo consiglio rispetto al servizio di abbonamento Chatbox AI.

Conclusione

Eseguire modelli linguistici di grandi dimensioni (LLM) in locale sul tuo Mac sarà importante per chiunque desideri ottenere un maggiore controllo sulle proprie applicazioni di intelligenza artificiale e dare priorità alla privacy dei dati. Con strumenti come Ollama e le interfacce grafiche sopra menzionate, che semplificano l'integrazione degli LLM nel tuo flusso di lavoro, puoi sbloccare in modo sicuro un nuovo potenziale di produttività e creatività.

Tuttavia, avviare una distribuzione LLM locale richiede una certa comprensione dei parametri e di come questi influenzano le prestazioni di questi modelli sulla macchina specifica. Il modo migliore per apprendere questo concetto è sperimentare diversi modelli per vedere quali offrono i risultati migliori. Una volta compreso questo concetto, sarai in grado di prendere decisioni migliori su quali modelli utilizzare e su come ottimizzarne le prestazioni in base alle tue esigenze specifiche.

I commenti sono chiusi.