Google lancia Gemini 2.0 Pro e Flash-Lite, collegando Flash Thinking a YouTube, Maps e Search

La serie Gemini di modelli linguistici di grandi dimensioni (LLM) di Google ha avuto un inizio travagliato circa un anno fa con alcune imbarazzanti immagini generate in modo errato, ma da allora è costantemente migliorata e l'azienda sembra intenzionata a rendere il suo secondo progetto, Gemini 2.0, il più grande e il migliore finora per consumatori e aziende.

اليوم, Annunciato L'azienda ha annunciato il rilascio pubblico di Gemini 2.0 Flash, ha introdotto Gemini 2.0 Flash-Lite e ha rilasciato una versione beta di Gemini 2.0 Pro.

Questi modelli, progettati per supportare sviluppatori e aziende, sono ora disponibili tramite Google AI Studio e Vertex AI, con Flash-Lite disponibile in anteprima pubblica e Pro disponibile per i test iniziali.

"Tutti questi modelli saranno dotati di input multimediale con output di testo al momento del rilascio, con Plus Media disponibile per l'uso generale nei prossimi mesi", ha scritto Koray Cavukcioglu, CTO di Google DeepMind, nel post del blog aziendale che annunciava l'annuncio, mostrando un vantaggio che Google sta portando sul tavolo anche se concorrenti come DeepSeek e OpenAI Nel lanciare concorrenti forti.

Google sfrutta le sue capacità multimediali

Né il DeepSeek-R1 né Il nuovo modello o3-mini di OpenAI Accetta input multimediali, ad esempio immagini, caricamenti di file o allegati.

Sebbene il modello R1 possa accettarli sul suo sito web e sulla sua app di chat mobile, utilizza il riconoscimento ottico dei caratteri (OCR), una tecnologia che ha più di 60 anni, per estrarre solo il testo da questi caricamenti e non comprende né analizza nessuna delle altre funzionalità in essi contenute.

Tuttavia, entrambi rappresentano una nuova classe di modelli di "pensiero" che deliberatamente prendono più tempo per pensare alle risposte e riflettere sulle "catene di pensiero" e sulla validità delle loro risposte. Ciò è in contrasto con i tipici modelli linguistici di grandi dimensioni come la serie Gemini 2.0 Pro, quindi confrontare Gemini 2.0 con DeepSeek-R1 e OpenAI o3 è come confrontare mele e arance.

Ma oggi ci sono state anche delle novità dal lato del pensiero da parte di Google: il CEO di Google Sundar Pichai ha annunciato tramite piattaforma X Informazioni sull'aggiornamento dell'applicazione Google Gemelli Per cellulari iOS e Android con Gemini 2.0 Flash Thinking. Il modello può essere collegato a Google Maps, YouTube e Google Search, consentendo una serie completamente nuova di ricerche e interazioni basate sull'intelligenza artificiale che i suoi nuovi concorrenti privi di questi servizi, come DeepSeek e OpenAI, non possono eguagliare.

Mentre scrivevo questo articolo, l'ho provato brevemente sull'app Google Gemini per iOS sul mio iPhone e, in base alle mie ricerche iniziali, è stato impressionante: ha trovato delle somiglianze tra i 10 video più visti su YouTube del mese scorso e mi ha fornito un elenco degli studi medici nelle vicinanze con i loro orari di apertura/chiusura, il tutto in pochi secondi.

Rilascio pubblico di Gemini 2.0 Flash

Il modello Gemini 2.0 Flash, inizialmente lanciato come versione beta, è diventato A dicembre, pronto per la produzione ora.

Progettato per applicazioni di intelligenza artificiale altamente efficienti, fornisce risposte a bassa latenza e supporta il ragionamento multimodale su larga scala.

Uno dei suoi principali vantaggi rispetto alla concorrenza è la finestra di contesto, ovvero il numero di token che un utente può aggiungere come incentivo e ricevere in un'unica interazione avanti e indietro con un chatbot o un'API basati su LLM.

Mentre molti modelli principali, come il nuovo o3-mini di OpenAI presentato la scorsa settimana, supportano 200000 token o meno, l'equivalente di un romanzo da 400 a 500 pagine, Gemini 2.0 Flash supporta XNUMX milione di token, il che significa che può gestire enormi quantità di informazioni, il che lo rende particolarmente utile per attività su larga scala e ad alta frequenza.

Gemini 2.0 Flash-Lite: soluzioni di intelligenza artificiale a basso costo

Gemini 2.0 Flash-Lite è un nuovissimo modello di linguaggio di grandi dimensioni che mira a fornire soluzioni di intelligenza artificiale convenienti senza compromettere la qualità.

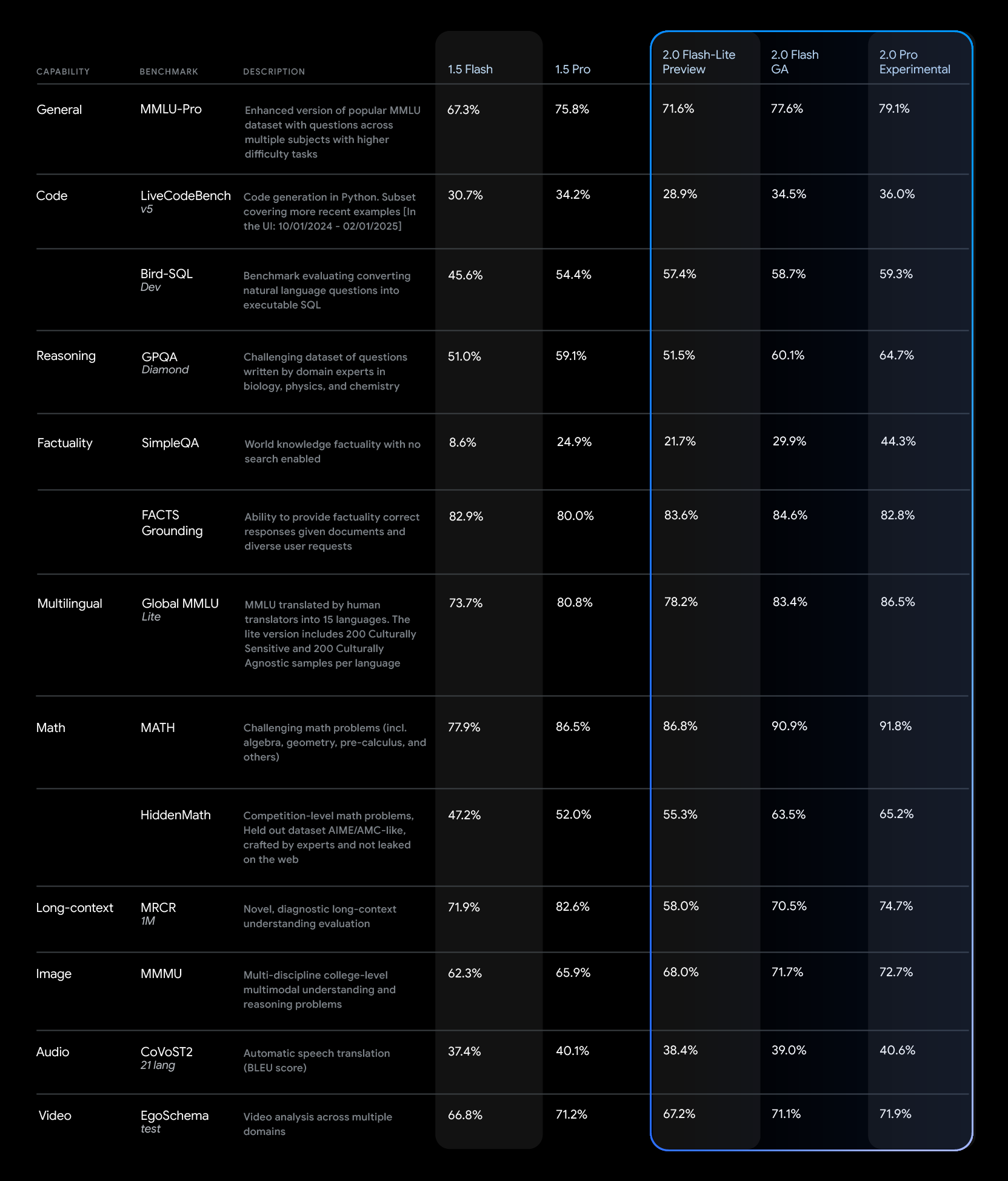

Google DeepMind segnala che Flash-Lite supera le prestazioni del suo predecessore full-size (più parametrico), Gemini 1.5 Flash, su benchmark esterni come MMLU Pro (77.6% contro 67.3%) e Bird SQL (57.4% contro 45.6%), mantenendo lo stesso prezzo e la stessa velocità.

Supporta inoltre l'input multimediale e presenta una finestra contestuale di 1 milione di token, simile al modello Flash completo.

Flash-Lite è attualmente disponibile in anteprima pubblica tramite Google AI Studio e Vertex AI; la disponibilità generale è prevista per le prossime settimane.

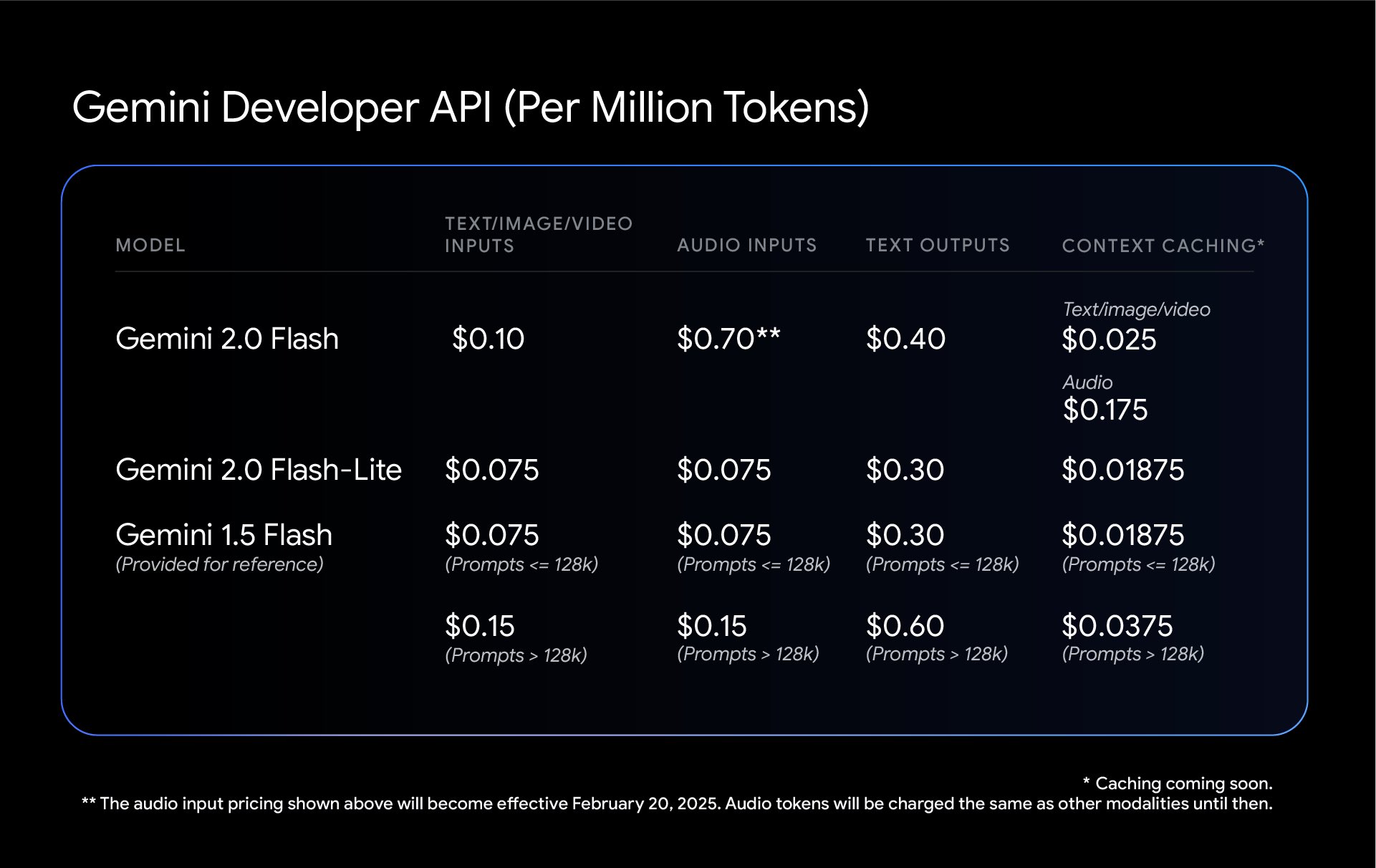

Come mostrato nella tabella sottostante, il prezzo di Gemini 2.0 Flash-Lite è di 0.075 $ per milione di token (input) e 0.30 $ per milione di token (output). Flash-Lite è un'opzione molto conveniente per gli sviluppatori, in quanto supera Gemini 1.5 Flash nella maggior parte dei benchmark, mantenendo la stessa struttura dei costi.

Logan Kilpatrick ha evidenziato il costo e il valore dei modelli Gemini 2.0 Flash, come Maschio sulla piattaforma X"Gemini 2.0 Flash è il modello LLM con il miglior rapporto qualità-prezzo, è il momento di costruirlo!"

Infatti, rispetto ad altri modelli LLM tradizionali leader disponibili tramite l'API del provider, come OpenAI 4o-mini ($ 0.15/$ 0.6 per milione di token I/O) e Claudio antropico ($ 0.8/$ 4! per milione di token I/O) e perfino il tradizionale LLM V3 di DeepSeek ($ 0.14/$ 0.28), Gemini 2.0 Flash sembra essere la soluzione con il miglior rapporto qualità-prezzo.

Gemini 2.0 Pro Beta arriva con 2 milioni di icone nella finestra contestuale

Il modello Gemini 2.0 Pro (beta) è ora disponibile per i test, per gli utenti che necessitano di funzionalità di intelligenza artificiale più avanzate.

Google DeepMind descrive questo modello come il più potente in termini di prestazioni di programmazione e capacità di gestire prompt complessi. È dotato di una finestra di contesto da 2 milioni di caratteri e di capacità di ragionamento avanzate, con la possibilità di integrare strumenti esterni come la Ricerca Google e l'esecuzione di codice.

Sam Witteveen, co-fondatore e CEO di Red Dragon AI ed esperto esterno di sviluppo di apprendimento automatico presso Google che spesso collabora con VentureBeat, ha discusso, Modello professionale nella recensione di YouTube. Il nuovo modello Gemini 2.0 Pro ha una finestra contestuale con 1.5 milioni di icone, supporta widget, esecuzione di codice, chiamate di funzioni e integrazione con Google Search: tutto ciò che avevamo in Pro XNUMX, ma migliorato.

Ha anche sottolineato l'approccio iterativo di Google allo sviluppo dell'intelligenza artificiale: "Una differenza fondamentale nella strategia di Google è che rilascia versioni beta dei modelli prima che diventino disponibili al pubblico (GA), consentendo una rapida iterazione basata sul feedback".

I benchmark delle prestazioni dimostrano ulteriormente le capacità della famiglia di modelli Gemini 2.0. Ad esempio, Gemini 2.0 Pro supera Flash e Flash-Lite in attività quali ragionamento, comprensione multilingue ed elaborazione di contesti estesi.

Sicurezza dell'intelligenza artificiale e sviluppi futuri

Sicurezza dell'intelligenza artificiale e sviluppi futuri

Oltre a questi aggiornamenti, Google DeepMind sta implementando nuove misure di sicurezza e protezione per i suoi modelli Gemini 2.0. L'azienda sfrutta tecniche di apprendimento per rinforzo per migliorare la precisione della risposta, utilizzando l'intelligenza artificiale per criticare e migliorare i propri risultati. Inoltre, vengono utilizzati test di sicurezza automatizzati per identificare le vulnerabilità, tra cui le minacce di iniezione di claim indiretti.

Guardando al futuro, Google DeepMind prevede di ampliare le capacità della famiglia di modelli Gemini 2.0, con metodi aggiuntivi oltre al testo che dovrebbero essere disponibili al pubblico nei prossimi mesi.

Con questi aggiornamenti, Google rafforza il suo impegno nello sviluppo dell'intelligenza artificiale, introducendo una serie di modelli progettati per l'efficienza, la convenienza e la risoluzione avanzata dei problemi, rispondendo all'ascesa di DeepSeek con la propria serie di modelli che vanno da potenti a molto potenti e molto convenienti a leggermente meno costosi (ma comunque convenienti).

Basterà questo per aiutare Google ad entrare nel mercato dell'intelligenza artificiale aziendale, in precedenza dominato da OpenAI e ora da DeepSeek? Continueremo a tenervi aggiornati e a farvi sapere!

Se vuoi fare colpo sul tuo capo, VB Daily ti aiuterà. Ti forniamo informazioni privilegiate su ciò che le aziende stanno facendo con l'intelligenza artificiale generativa, dalle trasformazioni organizzative alle implementazioni pratiche, in modo che tu possa condividere approfondimenti per massimizzare il tuo ROI.

Sicurezza dell'intelligenza artificiale e sviluppi futuri

Sicurezza dell'intelligenza artificiale e sviluppi futuri

I commenti sono chiusi.