Come l'intelligenza artificiale sta riscrivendo i compiti quotidiani degli scienziati dei dati

Dall'eliminazione di attività di basso valore all'accelerazione di progetti ad alto impatto, ecco come l'intelligenza artificiale sta rimodellando i flussi di lavoro della scienza dei dati.

Nei miei articoli precedenti ho esplorato e confrontato diversi strumenti di intelligenza artificiale, ad esempio il Data Science Agent di Google, ChatGPT contro Claude contro Gemini Per la scienza dei dati e DeepSeek V3, ecc. Tuttavia, questo è solo un piccolo sottoinsieme di tutti gli strumenti di intelligenza artificiale disponibili per Science Data. Ad esempio, alcuni degli strumenti che ho utilizzato nel mio lavoro:

- API OpenAI: Lo utilizzo per categorizzare e riassumere il feedback dei clienti e identificare i punti deboli del prodotto.

- ChatGPT e GeminiMi aiutano a scrivere bozze di messaggi ed e-mail su Slack, a scrivere report di analisi e persino a valutare le prestazioni.

- Raccogli l'IA:Glean ha utilizzato l'intelligenza artificiale per trovare rapidamente risposte nei documenti e nelle comunicazioni interne.

- Cursore e Secondo pilota: Mi piace semplicemente toccare Tab-Tab per completare automaticamente il codice e i commenti.

- Magia maledettaUtilizzo Hex per i fogli di calcolo collaborativi al lavoro. Offre anche una funzionalità chiamata Magia maledetta Scrivere codice e correggere bug utilizzando l'intelligenza artificiale conversazionale.

- Corteccia di fiocco di neveCortex AI consente agli utenti di richiamare endpoint LLM, creare RAG e servizi di conversione da testo a SQL utilizzando i dati in Snowflake.

Sono sicuro che potresti aggiungere altro a questa lista, e ogni giorno vengono rilasciati nuovi strumenti di intelligenza artificiale. È quasi impossibile ottenere un elenco completo a questo punto. Quindi, in questo articolo, vorrei fare un passo indietro e concentrarmi su una domanda più ampia: Di cosa abbiamo realmente bisogno come professionisti dei dati e in che modo l'intelligenza artificiale può aiutarci?؟

Nella sezione seguente mi concentrerò su due tendenze principali: l'eliminazione delle attività di basso valore e l'accelerazione delle attività di alto valore.

1. Eliminare le attività di basso valore

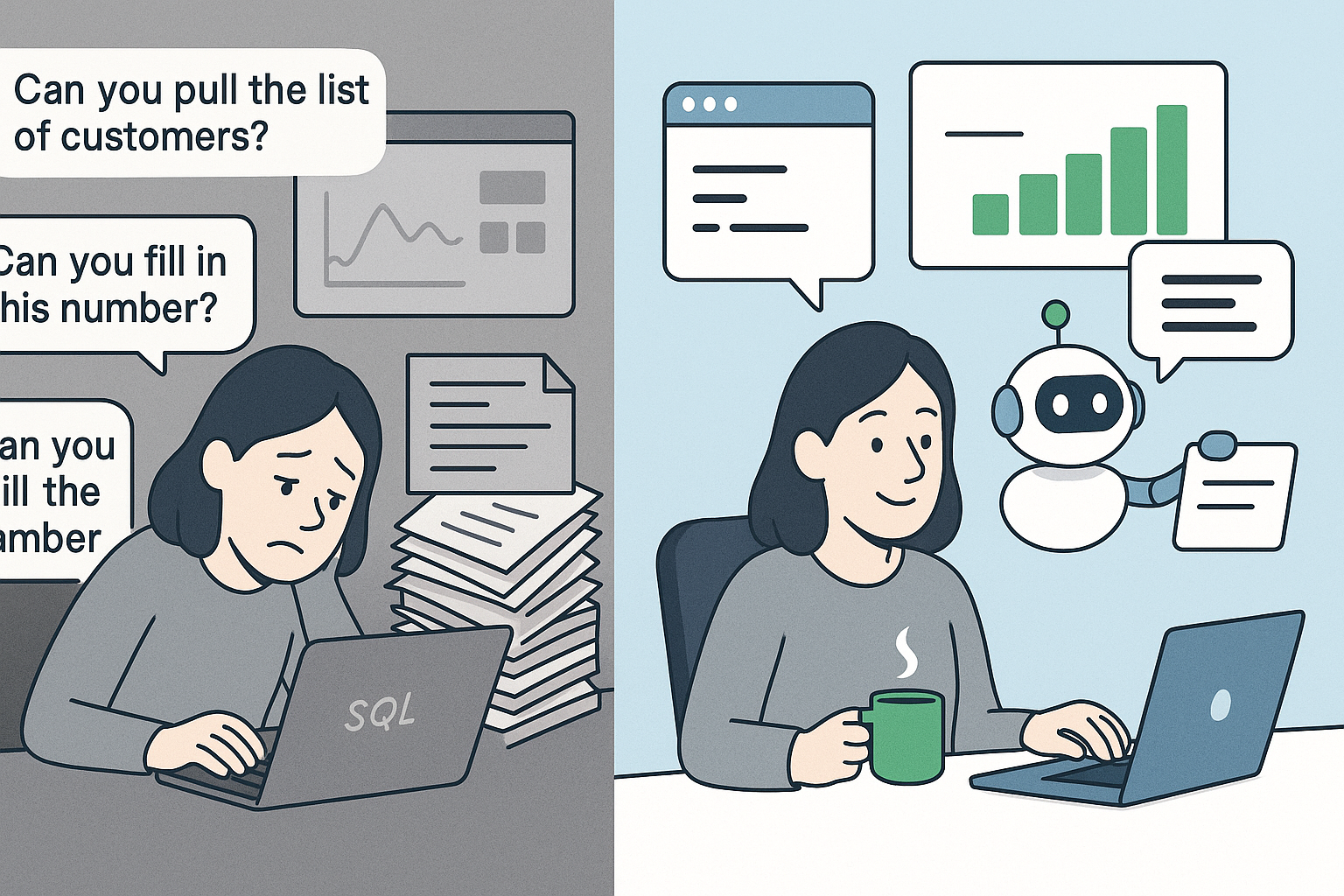

Sono diventato uno scienziato dei dati perché mi piace davvero estrarre informazioni aziendali da dati complessi e prendere decisioni aziendali basate su questi. Tuttavia, essendo in questo campo da oltre 7 anni, devo ammettere che non tutto il lavoro è entusiasmante come speravo. Prima di poter eseguire analisi avanzate o creare modelli di apprendimento automatico, è necessario eseguire quotidianamente molti flussi di lavoro di basso valore e, in molti casi, ciò avviene perché non disponiamo degli strumenti giusti per consentire ai nostri stakeholder di effettuare analisi self-service. Diamo un'occhiata alla nostra situazione attuale e al caso ideale:

Stato attuale: Operiamo come interpreti e guardiani dei dati (a volte “SQL monkeys”)

- Semplici richieste di pull dei dati Ogni settimana viene da me e dal mio team su Slack chiedendo: "Qual è stato il vostro Valore Lordo delle Merci (GMV) il mese scorso?" “Puoi procurarti un elenco di clienti che soddisfano questi criteri?” “Puoi aiutarmi a inserire questo numero per la presentazione che devo fare domani?”

- Gli strumenti di Business Intelligence (BI) non supportano bene i casi d'uso self-service.. Abbiamo adottato strumenti di business intelligence come Looker e Tableau per consentire alle parti interessate di esplorare facilmente i dati e monitorare le metriche. Ma la verità è che c'è sempre un compromesso tra semplicità e capacità di self-service. A volte realizziamo dashboard facili da comprendere con poche metriche, ma possono servire solo ad alcuni casi d'uso. Allo stesso tempo, se rendiamo lo strumento altamente personalizzabile, con la possibilità di esplorare liberamente le metriche e i dati sottostanti, le parti interessate potrebbero trovare lo strumento confuso e non avere la sicurezza di utilizzarlo e, nel peggiore dei casi, i dati potrebbero essere estratti e interpretati male.

- I documenti sono pochi o obsoleti.. Questa è una situazione comune, ma può essere causata da vari motivi: forse ci stiamo muovendo rapidamente e ci stiamo concentrando sul conseguimento di risultati, oppure non sono in atto una buona documentazione dei dati e politiche di governance. Di conseguenza, la conoscenza tribale diventa un ostacolo all'utilizzo dei dati da parte di persone esterne al team che si occupa di dati.

Caso ideale: consentire agli stakeholder di utilizzare il self-service in modo da ridurre il lavoro di basso valore

- Le parti interessate possono eseguire semplici estrazioni di dati e rispondere a domande di base sui dati con facilità e sicurezza.

- I team che si occupano di dati dedicano meno tempo alla preparazione di report ripetitivi o di semplici query una tantum.

- Le dashboard sono individuabili, interpretabili e utilizzabili senza assistenza diretta.

Quindi, per avvicinarci allo stato ideale, che ruolo può svolgere l'intelligenza artificiale in questo caso? Da quanto ho osservato, queste sono le tendenze comuni verso cui si stanno muovendo gli strumenti di intelligenza artificiale per colmare il divario:

- Query di dati in linguaggio naturale (da testo a SQL)Un modo per ridurre la barriera tecnica è consentire alle parti interessate di interrogare i dati in linguaggio naturale. Sono numerosi gli sforzi di conversione da testo a SQL nel settore:

- Per esempio, Fiocco di neve È una delle aziende che ha fatto molti progressi in Modelli Text2SQL E ha iniziato a integrare questa capacità nel suo prodotto.

- Molte aziende (compresa la mia) hanno esplorato internamente anche le soluzioni Text2SQL. Ad esempio, ho partecipato Uber Il suo viaggio con QueryGPT di Uber Per semplificare la ricerca dei dati da parte del team operativo. Questo articolo illustra nel dettaglio come Uber ha progettato un'architettura multi-agente per la generazione di query. Allo stesso tempo, ha anche evidenziato sfide significative in questo campo, tra cui l'interpretazione accurata delle intenzioni dell'utente, la gestione di grafici di grandi dimensioni, la prevenzione delle allucinazioni e così via.

- Francamente, per far funzionare Text-to-SQL, c'è un livello molto alto in cui devi rendere la query accurata: anche se lo strumento fallisce anche solo una volta, può distruggere la fiducia e alla fine le parti interessate torneranno da te per convalidare le query (e poi devi leggere e riscrivere le query, il che quasi raddoppia il lavoro 🙁). Finora non ho trovato un modello o uno strumento di conversione da testo a SQL che funzioni perfettamente. Ritengo che ciò sia realizzabile solo se si interroga un sottoinsieme molto piccolo di set di dati sottostanti ben documentati per casi d'uso specifici e standardizzati, ma è molto difficile scalarlo per includere tutti i dati disponibili e i diversi scenari aziendali.

- Ma ovviamente, visti gli ingenti investimenti in questo ambito e il rapido sviluppo dell'intelligenza artificiale, sono certo che ci avvicineremo sempre di più a soluzioni Text-to-SQL precise e scalabili.

- Assistente di Business Intelligence (BI) basato su chatUn altro ambito popolare per migliorare l'esperienza degli stakeholder con gli strumenti di BI è un assistente BI basato su chat. In realtà, questo rappresenta un ulteriore passo avanti rispetto a Text-to-SQL: invece di generare una query SQL basata sulla richiesta dell'utente, risponde in un formato di visualizzazione e con un riepilogo di testo.

- Gemelli in Looker Lui è un esempio in questo caso. Looker è di proprietà di Google, quindi è naturale che si integri con Gemini. Un altro vantaggio di Looker per la creazione della propria intelligenza artificiale è che i campi dati sono già documentati nel livello semantico LookML, con mappature comuni definite e metriche comuni incluse nei dashboard. Quindi, ci sono molti dati utili da cui imparare. Gemini consente agli utenti di personalizzare le dashboard di Looker, porre domande sui dati e persino creare agenti dati personalizzati per l'analisi conversazionale. Sebbene basandomi sulla mia limitata esperienza con lo strumento, spesso finisce per non riuscire a rispondere nemmeno alle domande più semplici. Fatemi sapere se avete avuto un'esperienza diversa e se avete risolto il problema...

- Tableau ha anche lanciato una funzionalità simile, Tavolo AI. Non l'ho utilizzato personalmente, ma in base alla demo, aiuta il team dei dati a preparare i dati, a creare rapidamente dashboard utilizzando il linguaggio naturale e a riassumere le informazioni sui dati in Tableau Pulse affinché le parti interessate possano identificare facilmente cambiamenti nelle metriche e tendenze anomale.

- Strumenti di indicizzazione dei datiL'intelligenza artificiale può anche aiutare a superare la sfida di avere poca o nessuna documentazione dei dati.

- Ricordo che durante un hackathon interno uno dei progetti dei nostri ingegneri dei dati prevedeva l'utilizzo di LLM per aumentare la copertura della documentazione delle tabelle. Nella maggior parte dei casi, l'intelligenza artificiale è in grado di leggere il codice di base e di descrivere le colonne di conseguenza con elevata accuratezza, quindi può aiutare a migliorare rapidamente la documentazione con limitate convalide e modifiche umane.

- Allo stesso modo, quando il mio team crea nuove tabelle, abbiamo iniziato a chiedere a Cursor di scrivere file YAML per la documentazione della tabella, per farci risparmiare tempo e ottenere un output di alta qualità.

- Esistono anche molti cataloghi di dati e strumenti di governance che sono stati integrati con l'intelligenza artificiale. Quando cerco su Google "indice dati AI", vedo i loghi di strumenti di indicizzazione dei dati come Atlan, Alation, Collibra, Informatica, ecc. (Disclaimer: non ne ho utilizzato nessuno). Si tratta di una chiara tendenza del settore.

2. Accelerare il lavoro di alto valore

Ora che abbiamo parlato di come l'intelligenza artificiale può contribuire a eliminare attività di basso valore, vediamo come può accelerare progetti di dati di alto valore. In questo caso, con "lavoro di alto valore" si intendono progetti sui dati che combinano l'eccellenza tecnica con il contesto aziendale e ottengono un impatto significativo attraverso la collaborazione interfunzionale. Ad esempio, un'analisi approfondita che comprende i modelli di utilizzo del prodotto e porta a modifiche del prodotto, oppure un modello di previsione dell'abbandono dei clienti per identificare i clienti a rischio di abbandono e portare a iniziative di prevenzione dell'abbandono. Confrontiamo la situazione attuale con il futuro ideale:

Stato attuale: Ci sono colli di bottiglia in Produttività Nel flusso di lavoro quotidiano

- L'analisi esplorativa dei dati (EDA) richiede molto tempo.. Questo passaggio è essenziale per acquisire una comprensione iniziale dei dati, ma eseguire tutte le analisi univariate e multivariate può richiedere molto tempo.

- Tempo sprecato in codifica e debug. Siamo onesti: nessuno riesce a ricordare tutti i parametri dei modelli numpy, pandas e sklearn. Durante la scrittura del codice abbiamo costantemente bisogno di cercare documentazione.

- I dati non strutturati di grandi dimensioni non vengono utilizzati appieno.. Ogni giorno le aziende generano grandi quantità di dati di testo tramite sondaggi, ticket di supporto e recensioni. Ma come estrarre informazioni in modo scalabile resta una sfida.

Caso ideale: gli scienziati dei dati si concentrano sul pensiero profondo, non sulla sintassi.

- Scrivere il codice risulta più veloce senza dover cercare la sintassi.

- Gli analisti dedicano più tempo all'interpretazione dei risultati e meno tempo all'elaborazione dei dati.

- I dati non strutturati non rappresentano più un ostacolo e possono essere analizzati rapidamente.

Quando vedi il caso ideale, sono sicuro che hai già in mente alcuni strumenti di intelligenza artificiale. Vediamo come l'intelligenza artificiale può realmente avere un impatto o fare la differenza:

- Assistenti AI per la codifica e il debug. Penso che questo sia di gran lunga il tipo di strumento di intelligenza artificiale più affidabile per chiunque si occupi di programmazione. Lo stiamo già vedendo accadere di nuovo.

- Quando i chatbot LLM come ChatGPT e ClaudeGli ingegneri si resero conto che potevano semplicemente porre domande sulla sintassi o messaggi di errore a un chatbot che avrebbe ottenuto risposte estremamente precise. Si tratta comunque di un'interruzione del flusso di lavoro di codifica, ma è molto meglio che cliccare su decine di schede di StackOverflow, e questo sembra già il secolo scorso.

- Più tardi, vediamo emergere Plus e Plus di strumenti di codifica AI integrati: integrati Copilota GitHub e Cursore Grazie al tuo editor di codice, possono leggere la tua base di codice per suggerire in modo proattivo il completamento del codice e risolvere i problemi all'interno del tuo IDE.

- Come ho accennato brevemente all'inizio, strumenti di dati come Fiocco di neve e Hex Include anche assistenti di codifica basati sull'intelligenza artificiale per aiutare gli analisti e gli scienziati dei dati a scrivere codice con facilità.

- Intelligenza artificiale per l'analisi e l'analisi esplorativa dei dati. È in qualche modo simile agli strumenti di assistenza BI basati su chat che ho menzionato sopra, ma il suo obiettivo è più ambizioso: inizia con set di dati grezzi e punta ad automatizzare l'intero ciclo di analisi della pulizia dei dati, della pre-elaborazione, dell'analisi esplorativa e talvolta anche della modellazione. Si tratta di strumenti che spesso vengono pubblicizzati come "sostitutivi degli analisti di dati" (ma è davvero così?).

- Agente di scienza dei dati di Google Si tratta di un nuovo strumento davvero impressionante, in grado di creare un intero Jupyter Notebook con un semplice prompt. Ho scritto di recente un articolo Spiega cosa può e cosa non può fare. In breve, è in grado di creare rapidamente un Jupyter Notebook ben organizzato che viene eseguito in base a un piano di esecuzione personalizzabile. Tuttavia, non ha la capacità di modificare un Jupyter Notebook in base a domande di follow-up, richiede comunque qualcuno con solide conoscenze di data science per rivedere i metodi ed eseguire iterazioni manuali e richiede una chiara definizione del problema dei dati con set di dati puliti e ben documentati. Quindi, lo vedo come un ottimo strumento per risparmiare tempo nella scrittura del codice iniziale, anziché mettere a repentaglio il nostro lavoro.

- Può anche essere classificato come Strumento di analisi dati ChatGPT In questo ambito. Consente agli utenti di caricare un set di dati e di chattare con esso per completare l'analisi, creare visualizzazioni e rispondere alle domande. Potete trovare il mio articolo precedente in cui ne vengono illustrate le capacità. qui. Affronta sfide simili e funziona meglio come assistente EDA piuttosto che come sostituto degli analisti di dati.

- Le funzionalità NLP sono facili da usare e scalabili.. L'LLM è ottimo per le conversazioni. Per questo motivo, con l'attuale LLM la PNL è diventata molto più semplice.

- Ogni anno la mia azienda organizza un hackathon interno. Ricordo che il mio progetto di hackathon di tre anni fa consisteva nel provare BERT e altri metodi tradizionali di modellazione degli argomenti per analizzare le risposte al sondaggio NPS, il che è stato divertente ma, onestamente, molto difficile da rendere accurato e significativo per l'azienda. Poi due anni fa, durante un hackathon, abbiamo provato API OpenAI Classificare e riassumere i dati di feedback stessi ha funzionato alla perfezione, consentendo la modellazione tematica ad alta fedeltà, l'analisi del sentiment e la classificazione del feedback, il tutto in un'unica chiamata API, e l'output si adattava perfettamente al nostro contesto aziendale in base ai prompt di sistema. In seguito, abbiamo creato una pipeline interna che si è facilmente espansa per includere dati testuali provenienti da risposte a sondaggi, ticket di supporto, chiamate di vendita, note di ricerca degli utenti, ecc. È diventata il fulcro centrale per il feedback dei clienti e ha influenzato la nostra roadmap di prodotto. Puoi trovare Plus su Questo blog tecnico.

- Esistono anche molte nuove aziende che sviluppano strumenti di analisi del feedback dei clienti basati sull'intelligenza artificiale, strumenti di analisi delle recensioni dei prodotti, strumenti di assistenza al servizio clienti e molto altro ancora. L'idea è la stessa per tutti: sfruttare il modo in cui LLM riesce a comprendere il contesto del testo e a condurre conversazioni per creare agenti di intelligenza artificiale specializzati nell'analisi del testo.

Conclusione

È facile lasciarsi travolgere dagli ultimi strumenti di intelligenza artificiale (IA). Ma in definitiva, ciò che conta di più è usare l'intelligenza artificiale per eliminare ciò che ci rallenta e accelerare ciò che ci fa progredire. La chiave è restare pragmatici: adottare ciò che funziona oggi, restare curiosi di ciò che emerge e non perdere mai di vista l'obiettivo principale della scienza dei dati, che è quello di prendere decisioni migliori attraverso una migliore comprensione.

I commenti sono chiusi.