La mia esperienza personale: gestire localmente un chatbot AI reale su un iPhone

Chatbot basati sull'intelligenza artificiale, come: ChatGPT e Gemini...affidarsi al cloud computing per funzionare. Ma cosa succederebbe se fosse possibile eseguire un modello linguistico di grandi dimensioni (LLM) direttamente sul tuo iPhone, senza richiedere un abbonamento, una connessione internet o persino la trasmissione dei dati dal dispositivo? Grazie a una suite di app e modelli leggeri e compatti, questo è già possibile.

L'ho provato personalmente ed ecco cosa devi sapere.

Esegui l'intelligenza artificiale localmente su iPhone

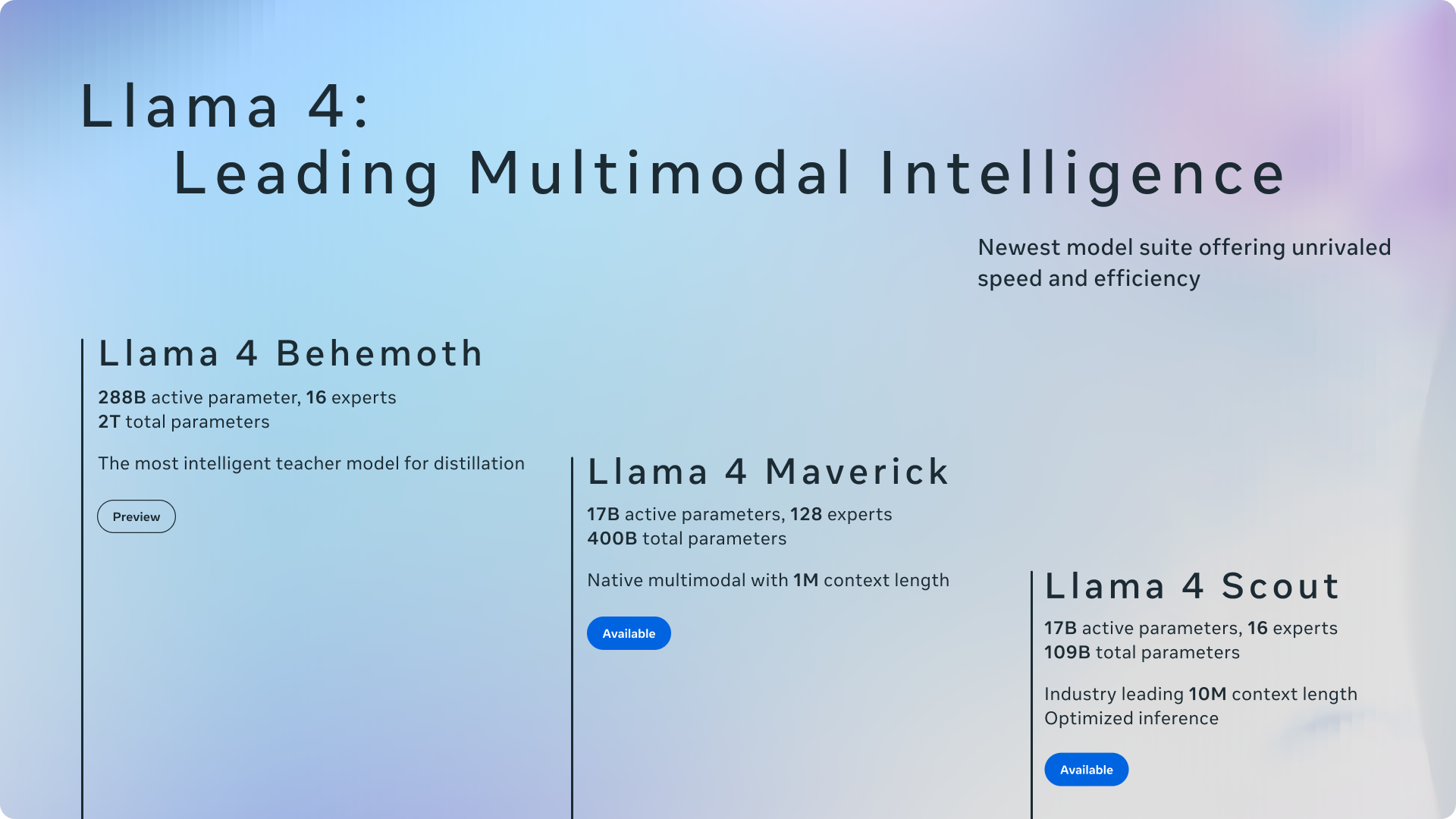

Ora puoi eseguire modelli open source come Lama e Qwen Direttamente su iOS. Questi modelli vengono ridotti utilizzando un processo chiamato quantizzazione, che li comprime per adattarli alla memoria del dispositivo mobile senza influire in modo significativo sulle prestazioni.

Ma c'è un punto importante: le prestazioni dipendono fortemente dal dispositivo. Ad esempio, l'iPhone 15 Pro o 15 Pro Max, dotato dell'ultimo chip Apple, può supportare modelli con fino a 7 o 8 miliardi di parametri (come il Llama 3.1 8B), mentre i telefoni più vecchi sono più adatti a modelli più piccoli con parametri compresi tra 1 e 3 miliardi.

App che lo rendono possibile

- LLM Farm (gratuito): Il modo più semplice per iniziare. Puoi scaricare un piccolo modello (come Phi-3.5 Instruct) ed eseguirlo offline con un solo clic. È sorprendentemente fluido per query rapide.

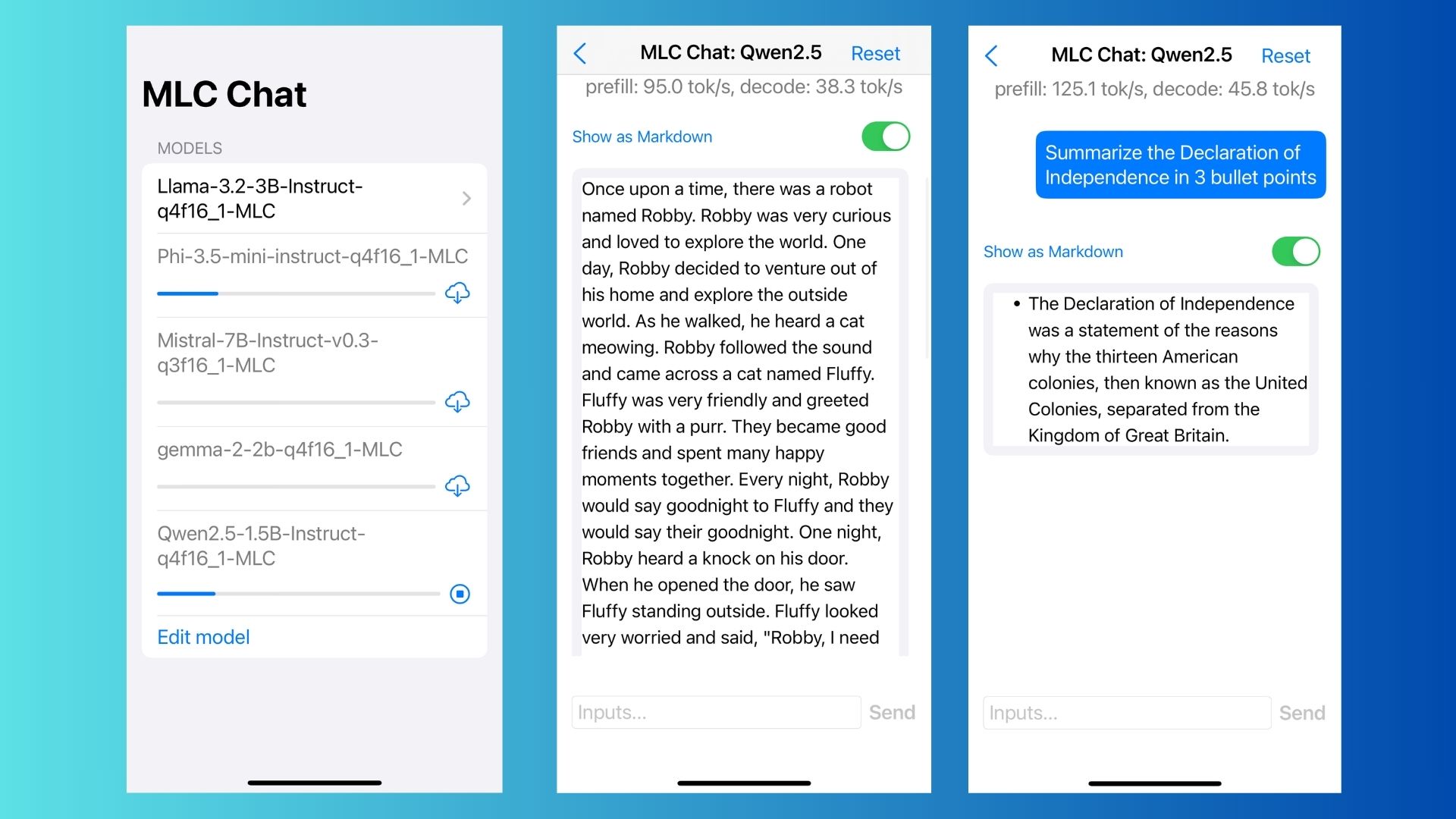

- Chat MLC (gratuita):

Questa è l'app che ho usato. Volevo provare LLM Farm, ma per qualche motivo non era disponibile per il download sull'App Store di Apple. Dato che è gratuita, l'ho provata e ha funzionato perfettamente. - LLM privato (progetto comunitario): Questa opzione è più un progetto fai da te che per l'utente medio. L'app include guide dettagliate per scaricare modelli come Llama 3.1 e Qwen sul tuo iPhone. Se ami sperimentare e sperimentare, vale sicuramente la pena provarla.

- Apollo (a pagamento): Ne ho sentito parlare bene, ma non l'ho ancora provata personalmente. Fatemi sapere nei commenti cosa ne pensate di questa app incentrata sulla privacy.

Come eseguire il modello localmente

Dopo aver scaricato l'app desiderata, aprila. Da lì, scorri l'elenco dei modelli integrati e selezionane uno (ad esempio, Phi-3.5 Instruct Q4 quantizzato). Ho scelto Qwen 2.5 per il semplice motivo che non la usavo da un po'.

Una volta scaricato, vedrai il modulo sul tuo dispositivo (le sue dimensioni variano da poche centinaia di megabyte a diversi gigabyte). Da lì, puoi semplicemente iniziare a chattare.

Dovrai essere realista: non è il momento di chiedere analisi approfondite o piani lunghi e dettagliati. Considera quanto segue:

- la velocità: I modelli di piccole dimensioni (da 1 a 3 miliardi di parametri) rispondono più velocemente, mentre i modelli di grandi dimensioni possono impiegare secondi per simbolo.

- Contesto: Non incollare articoli interi; fai in modo che i prompt siano più brevi.

- Produzione: I modelli linguistici locali di grandi dimensioni potrebbero essere meno accurati di ChatGPT, ma sono utili per prendere appunti, riepiloghi, domande e risposte e bozze leggere.

Mi sono divertito a provare alcuni dei prompt. Niente di complicato; volevo solo vedere che tipo di risposte ricevevo dalla richiesta locale. Una cosa che noterete subito è la velocità. È incredibile la rapidità con cui un modello linguistico di grandi dimensioni risponde.

Ho provato le seguenti affermazioni e, nel complesso, i risultati mi sono piaciuti.

- Riassumi la Dichiarazione d'Indipendenza in tre punti.

- “Scrivi una breve storia della buonanotte su un robot e un gatto.”

- "Dammi tre idee per una cena a base di pollo, riso e broccoli."

Gestire un modello di lingua locale di grandi dimensioni non è la stessa cosa che chattare con CatGPT-5Sembra certamente semplicistico e rozzo. Se provate questa soluzione, ricordate di mantenere brevi i prompt, poiché le finestre di contesto sono molto più limitate rispetto alla versione standard del chatbot. Avrete la sensazione che le risposte siano più lente se sovraccaricate il modello linguistico locale.

Perché lo faresti?

- Non ci sono costi di abbonamento. Non è necessario esaurire il tuo credito solo per provarci.

- Privacy integrata. Tutto rimane sul tuo dispositivo.

- Sorprendentemente versatile. Sono rimasto davvero stupito dalla quantità di compiti che la miniatura riusciva a gestire. Ogni volta che ne mettevo alla prova i limiti, riusciva a superare la sfida con facilità.

La linea di fondo

Se hai un iPhone 15 o successivo e vuoi esplorare come appare l'intelligenza artificiale "dall'interno", inizia da lì. Può essere LLM Farm O MLCChat Un modo rapido e gratuito per iniziare. Se tieni alla privacy, l'app Apollo Vale la pena provare. Se sei un fan della sperimentazione e della personalizzazione, LLM privato Consente di approfondire le impostazioni personalizzate.

Ricorda solo che questi non sono i chatbot completamente potenti a cui sei abituato, quindi non aspettarti risultati simili a quelli di ChatGPT. Ma è piuttosto interessante e futuristico poter gestire la tua intelligenza artificiale sul tuo iPhone.

I commenti sono chiusi.