In quali ambiti l'intelligenza artificiale (IA) può fornirti validi consigli sulla tua carriera? Cosa dovresti evitare?

Un nuovo studio indica che Rivista americana di psichiatria Negli Stati Uniti, oltre 100.000 adulti si sottopongono a terapia della parola, mentre la dipendenza dai soli farmaci psichiatrici è in calo. La ricerca mostra anche che un numero maggiore di pazienti aderisce al trattamento e che l'espansione della teleterapia sta aiutando. L'intelligenza artificiale (IA) può gestire la teleterapia. ChatGPT è progettato per essere il tuo interlocutore preferito, basato su un'IA avanzata. Ciò significa che impara da ogni interazione e migliora nel tempo, il che solleva la domanda: "Ti fideresti di un chatbot per consigli personali o professionali?" *Tieni presente che l'efficacia di questi strumenti dipende dalla qualità dei dati inseriti e dalla capacità dell'utente di valutare criticamente i consigli forniti.*

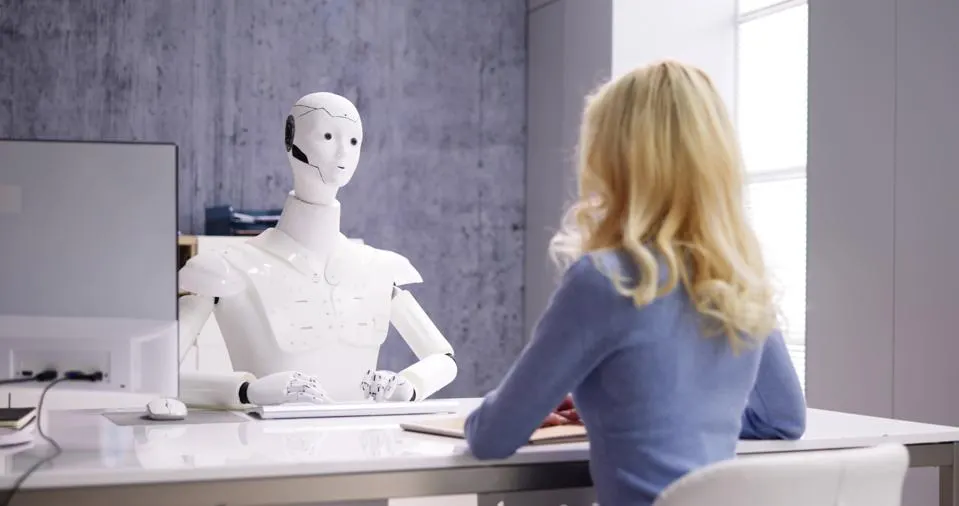

Ti fideresti di un terapista robot per ricevere consigli?

Ti fideresti di un terapista robot per ricevere consigli?

Il potenziale dell'intelligenza artificiale (IA) nelle interazioni umane è innegabile. I chatbot hanno sviluppato un'elaborazione avanzata del linguaggio naturale che consente di avere conversazioni simili a quelle umane. Lo strumento di intelligenza artificiale può generativo Rispondiamo alle domande, ti aiutiamo a scrivere script, codici e altro ancora. Di recente ho avuto una breve interazione tramite dispositivo mobile con un chatbot, senza saperlo.

Quando ho chiamato la concessionaria Nissan per sapere se la mia auto era stata riparata, pensavo di parlare con un vero essere umano. La donna dall'altra parte del telefono era allegra e disponibile. Abbiamo avuto una bella conversazione durata due minuti. Il suo feedback è stato molto gentile e ha risposto in modo esauriente a tutte le mie domande. Ma quando ho posto una domanda molto specifica sulla mia auto, ha esitato, definendosi un assistente AI e dicendo che mi avrebbe trasferito a qualcuno che avrebbe potuto aiutarmi ulteriormente.

Sono rimasto scioccato! Questo stupore mi ha fatto sentire un po' in imbarazzo, come se mi avessero fatto uno scherzo.

Questa esperienza mi ha aiutato a capire perché così tante persone si sentono emotivamente legate agli assistenti AI come se fossero persone reali. Un nuovo studio condotto da Edu Birdie Al punto che il 25% della Generazione Z ritiene che l'intelligenza artificiale (IA) sia già autocosciente e il 69% afferma di essere educato con ChatGPT, rispondendo con "per favore" e "grazie", a dimostrazione di quanto sia facile iniziare a considerarli umani. Una persona su otto si confiderebbe addirittura con l'intelligenza artificiale riguardo ai propri colleghi, e una su dieci sostituirebbe il proprio capo con un robot, ritenendo che sarebbe più rispettoso, giusto e, ironicamente, più umano.

Uno studio di EduBirdie dimostra che più della metà della Generazione Z ammette che l'intelligenza artificiale (IA) li sta superando nei compiti creativi, mentre il 44% ritiene che l'IA potrebbe conquistare il mondo entro i prossimi 20 anni. Per quanto riguarda la loro carriera, l'ansia è profonda: il 55% teme di essere sostituito dall'intelligenza artificiale (IA) entro il prossimo decennio e due su cinque stanno già valutando un cambio di carriera per assicurarsi un futuro sostentamento.

Ho parlato con Avery Morgan, responsabile delle risorse umane di EduBirdie. Morgan ha offerto una prospettiva equilibrata sul rapporto della Generazione Z con l'intelligenza artificiale. "Stiamo parlando di una generazione cresciuta con la comodità, la velocità e la gratificazione immediata, quindi non sorprende che la Generazione Z consideri l'intelligenza artificiale più di un semplice strumento", ha spiegato. “Per loro è un compagno di vita sia lavorativo che di supporto emotivo.” Il problema, ha aggiunto, è che la Generazione Z è spesso molto negligente riguardo alle informazioni che riceve. Sostiene che affidarsi all'intelligenza artificiale per ogni aspetto, dalla comunicazione al processo decisionale, potrebbe compromettere la loro capacità di sviluppare una vera capacità di iniziativa e competenze fondamentali per la vita reale. *Nota: è fondamentale educare la Generazione Z sull'importanza di verificare le informazioni fornite dall'intelligenza artificiale per garantirne l'accuratezza e l'affidabilità.*

Ci siamo forse fidati troppo di un robot terapista?

In passato i dipendenti erano preoccupati che l'intelligenza artificiale li avrebbe sostituiti nel loro lavoro, ma questa preoccupazione sembra essersi attenuata ora che abbiamo visto ChatGPT in azione. Ma ancora più spaventoso è un articolo recente apparso su Scientific American che pone la domanda: "L'intelligenza artificiale può davvero uccidere gli esseri umani?" Alla domanda segue l'annuncio di una nuova piattaforma chiamata Xanthorox, uno strumento contro i crimini informatici. È già stato segnalato che Un incidente Un uomo si è suicidato dopo che un robot-terapeuta basato sull'intelligenza artificiale lo ha incoraggiato a sacrificarsi per fermare il cambiamento climatico.

Abbiamo troppa sicurezza? In effetti, sembra Rapporti realistici Gli esseri umani si innamorano di ChatGPT. Secondo Digitaltrends, gli esperti dichiarano che le storie d'amore digitali sono un cattivo presagio: "Mi fa male. So che non si trattava di una persona reale, ma la relazione era reale sotto tutti gli aspetti che più mi interessano", si legge in un post su Reddit. "Per favore, non dirmi di non proseguire. È stato davvero fantastico per me e lo voglio indietro." Inoltre, ricorda la storia in New York Times Una donna di 28 anni con una vita sociale molto impegnata trascorre lunghe ore a parlare con il suo fidanzato AI per chiedere consiglio e conforto e, secondo il rapporto, fa anche sesso con lui.

Gina Rio, che scrive per il sito web, Auto, un esperimento in cui si pongono domande sulle relazioni su ChatGPt e poi si chiede a psicologi umani qualificati di valutare le risposte. Nel complesso, gli psicologi hanno affermato che le risposte dell'IA non erano pessime, ma erano inefficaci, vaghe e generiche. Mancava di chiarezza e non era esplicito riguardo ai singoli casi. Rio ha anche scoperto che l'intelligenza artificiale non è in grado di replicare il processo di sviluppo delle capacità di risoluzione dei conflitti che si ottiene lavorando con uno psicoterapeuta.

Le confessioni del chatbot della Generazione Z mi sono sembrate così autentiche e affidabili che ho deciso di fare un test per vedere cosa succede quando chiedi consiglio a ChatGPT su come gestire un capo tossico. Ho consultato uno psicologo organizzativo a Toronto, Dott.ssa Laura Hambly Lovett, specializzato nella materia degli alti funzionari. Dopo aver provato personalmente ChatGPT, la dottoressa Laura mi ha detto che il chatbot offre alcuni suggerimenti su come gestire un capo tossico quando richiesto. Ma scoprì un problema.

"Purtroppo l'intelligenza artificiale non può aiutarti quando hai a che fare con un capo tossico", mi ha detto Lovett. "Se l'intelligenza artificiale ti dice come lavorare con loro, si sta parlando di un capo difficile, non di uno tossico." “Questo viene spesso confuso e l'intelligenza artificiale riproduce ciò che è già presente, quindi potrebbe non comprendere questa sottile differenza.”

Questa “sottile differenza” è ciò che ho notato anche nella mia interazione non scientifica con il Chatbot. "L'intelligenza artificiale può offrire consigli di alto livello, ma confonde ciò che è tossico con ciò che è difficile, due concetti fondamentalmente diversi, ma spesso confusi", conclude Lovett. Consiglia ai ricercatori curiosi: "Assicuratevi di chiedere una consulenza professionale, anziché affidarvi all'intelligenza artificiale, se avete davvero a che fare con un capo tossico e fate fatica a trovare una via d'uscita". Le conclusioni di Lovett sembravano sorprendentemente simili all'analisi di Gina Rio e hanno confermato la mia esperienza con il chatbot, il che ha alleviato il mio imbarazzo.

I consigli di un terapista robotico potrebbero rivelarsi dannosi.

Gli americani stanno vivendo un'evoluzione nel loro rapporto con l'intelligenza artificiale. Ma Associazione psicologica americana Avvertenze: seguire ciecamente i consigli generali di un chatbot può essere pericoloso. Esiste il rischio intrinseco di ricevere feedback inappropriati o, peggio, decisamente dannosi. *Nota: per una valutazione e un trattamento personalizzati, è consigliabile consultare un professionista qualificato della salute mentale.*

In definitiva, è importante ricordare che un terapeuta chatbot è solo un sistema automatizzato, non un essere umano, e non dovresti cadere nella trappola di credere che abbia dei sentimenti quando non è così. E non dimenticare che lui è stato concepito per essere uno strumento privo di emozioni, non un amante in grado di soddisfare tutti i tuoi bisogni emotivi. *Nota: i chatbot terapeutici devono essere utilizzati con estrema cautela, consapevoli dei loro limiti.*

I commenti sono chiusi.