Come installare e utilizzare Ollama per eseguire modelli linguistici di grandi dimensioni (LLM) sul tuo computer Windows 11

Esistono diversi modi per eseguire modelli linguistici di grandi dimensioni (LLM) localmente sul tuo computer Windows e Ollama è uno dei più semplici ed efficienti.

L'interazione più comune che la maggior parte di noi ha con l'intelligenza artificiale in questo momento avviene tramite strumenti basati su cloud come ChatGPT O Secondo pilotaPer utilizzare questi strumenti è necessaria una connessione a Internet, ma lo svantaggio è che possono essere utilizzati su quasi tutti i dispositivi.

Ma non tutti vogliono affidarsi al cloud per le applicazioni di intelligenza artificiale, soprattutto gli sviluppatori. Pertanto, è preferibile che il modello linguistico di grandi dimensioni (LLM) venga eseguito localmente sul dispositivo. È qui che entra in gioco Ollama.

Ollama è uno strumento di inferenza che consente di eseguire un'ampia gamma di modelli linguistici di grandi dimensioni (LLM) in modo nativo sul computer. Non è l'unico modo per farlo, ma è uno dei più semplici e diretti. Ollama consente di sfruttare la potenza dell'intelligenza artificiale senza richiedere una connessione Internet costante, offrendo il controllo completo sui dati e sulla privacy.

Una volta che sei operativo, puoi fare molto con Ollama e i grandi modelli linguistici (LLM) che utilizza, ma il primo passo è la configurazione. Ti guideremo passo dopo passo attraverso questo processo per aiutarti a sfruttare al meglio questo potente strumento.

Requisiti di sistema di Ollama

L'esecuzione di Ollama non consuma molte risorse di sistema e può essere eseguita su un'ampia gamma di dispositivi. È compatibile con Windows 11, macOS e Linux. Puoi persino utilizzarlo dalle tue distribuzioni Linux all'interno di Windows 11 tramite WSL.

Tuttavia, l'esecuzione di modelli linguistici di grandi dimensioni (LLM) richiede hardware più potente. Più grande è il modello, maggiore è la potenza di elaborazione necessaria. Questi modelli richiedono un'unità di elaborazione grafica (GPU) per funzionare. Attualmente, non sono ottimizzati per l'unità di elaborazione neurale (NPU) dei nuovi PC Copilot+.

Fortunatamente, esistono modelli di piccole dimensioni che è possibile utilizzare su hardware modesto. Ad esempio, il modello Gemma 3 di Google ha un modello da 1 miliardo di parametri che richiede solo 2.3 GB di memoria visiva ad accesso casuale (VRAM) per eseguire il modello completo. Questo numero aumenta a oltre 9 GB di VRAM se si passa al modello da 4 miliardi di parametri.

Lo stesso vale per Llama 3.2 di Meta, dove il modello da 1 miliardo di parametri richiede una GPU con soli 4 GB di VRAM per funzionare correttamente. Questa quantità aumenta a 8 GB per il modello da 3 miliardi di parametri.

In breve, se hai un computer relativamente moderno con almeno 8 GB di RAM e una GPU dedicata, dovresti riuscire a ottenere qualche vantaggio utilizzando Ollama.

Guida all'installazione di Ollama su Windows 11

L'installazione di Ollama su Windows 11 è un processo molto semplice, che si riassume nel download Installa il programma dal sito ufficiale O da Archivio GitHub, quindi installalo sul tuo dispositivo.

Ecco i semplici passaggi.

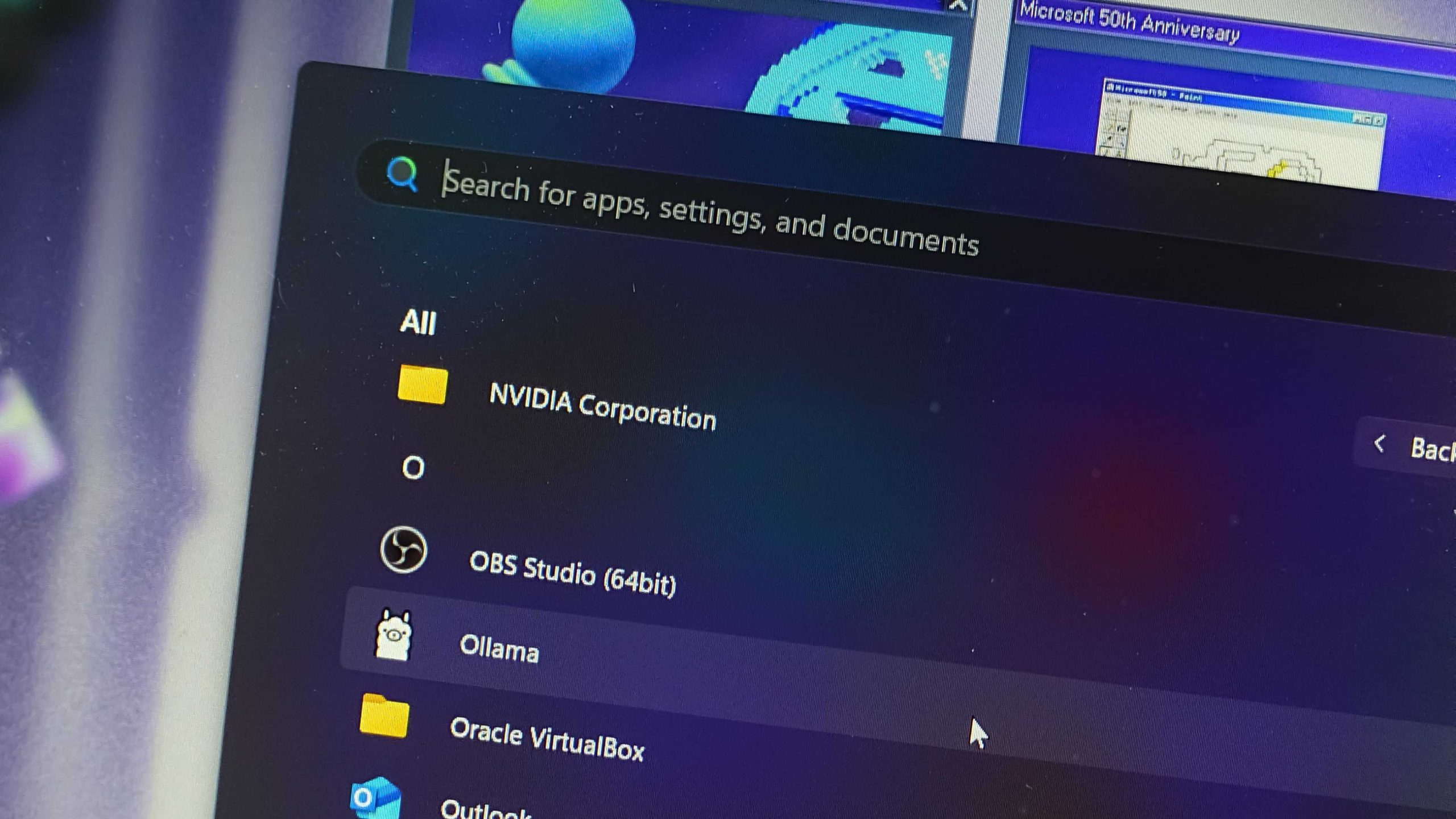

Dopo l'installazione e l'avvio, non apparirà nulla sul desktop. Il programma viene eseguito interamente in background, ma è possibile vedere la sua icona nella barra delle applicazioni.

Per verificare che il programma funzioni correttamente, puoi andare all'indirizzo localhost: 11434 nel tuo browser web.

Installa ed esegui il tuo primo modello linguistico di grandi dimensioni (LLM) su Ollama

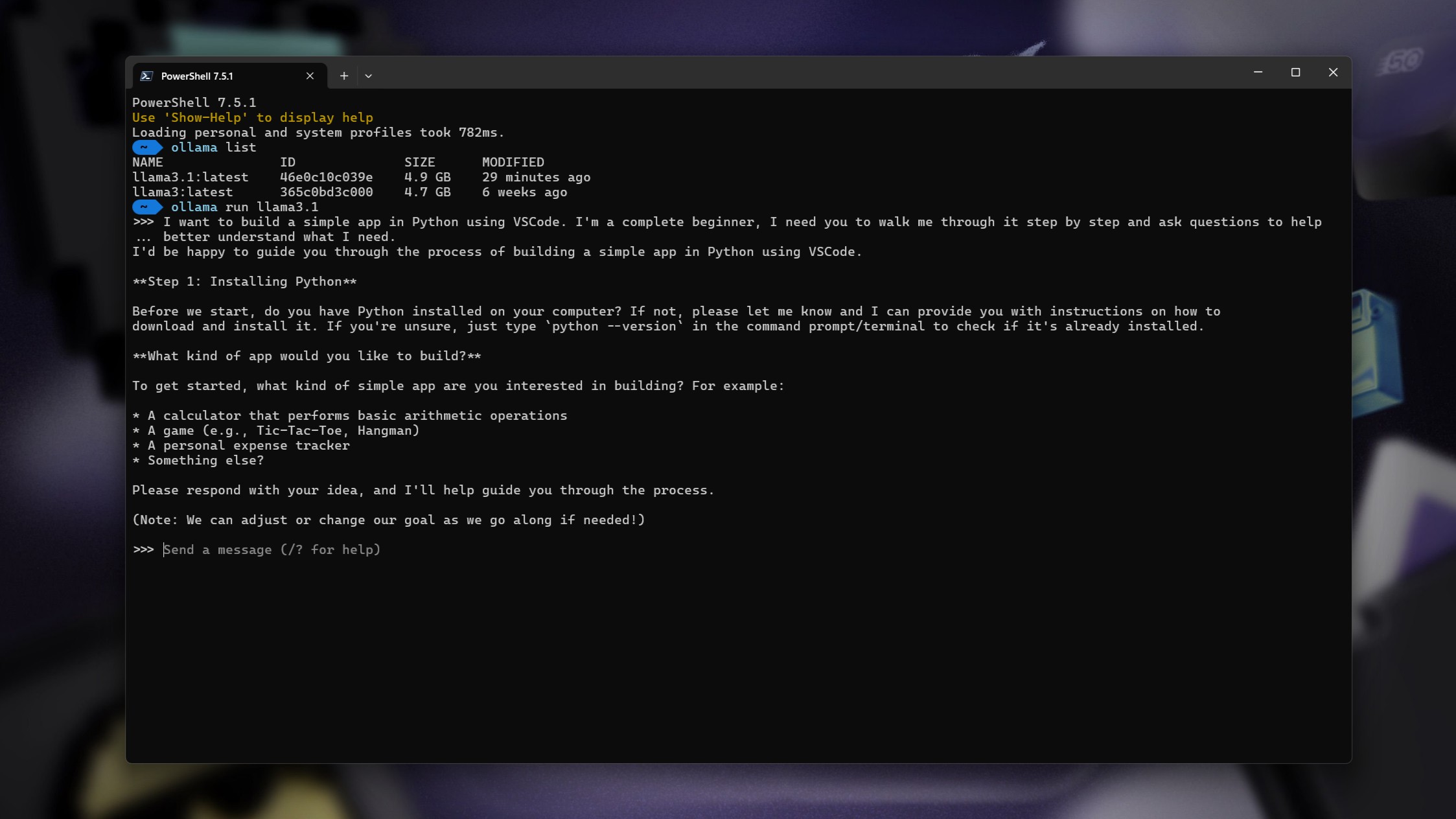

Per eseguire il tuo primo modello linguistico di grandi dimensioni (LLM) con Ollama, dovrai principalmente utilizzare l'interfaccia a riga di comando (CLI). Apri PowerShell su Windows o usa WSL se Ollama è installato lì.

Sebbene esistano interfacce utente grafiche (GUI) per Ollama, qui ci concentreremo sull'uso della riga di comando. È utile se si ha familiarità con l'uso della CLI.

Le due cose principali che devi sapere sono:

correre

mettilo

Se chiedi a Ollama di eseguire un modello LLM che non è attualmente installato, lo scaricherà automaticamente prima e poi lo eseguirà. Puoi trovare facilmente i nomi corretti per i modelli linguistici di grandi dimensioni che desideri installare qui. Sito web di Ollama.

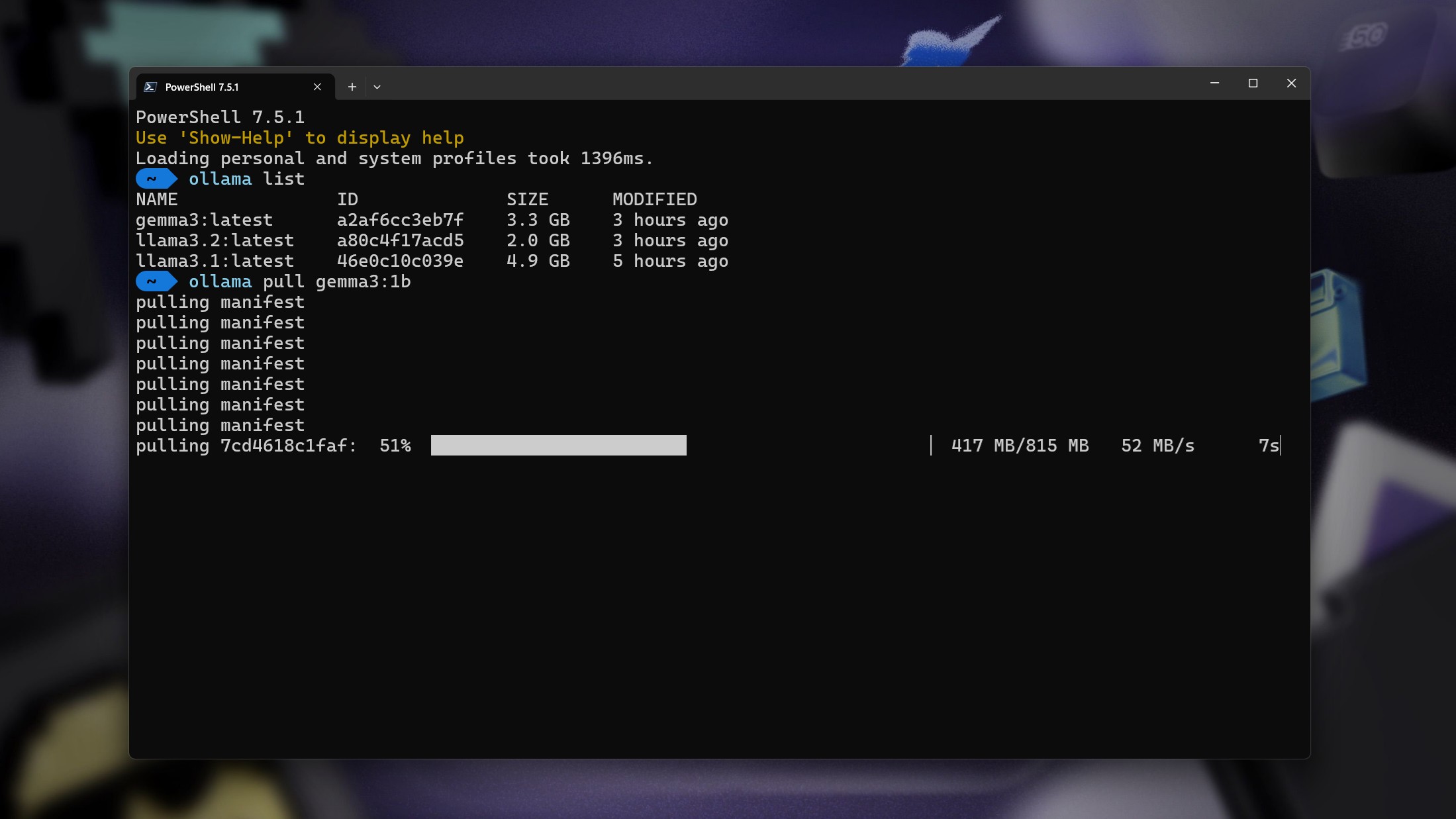

Ad esempio, per installare ed eseguire il modello Google Gemma 3 LLM da 1 miliardo di parametri, immettere il seguente comando:

ollama run Gemma:1b

Nota che l'aggiunta :1b Dopo il nome, specifica che desideri il modello da 1 miliardo di parametri. Se desideri il modello da 4 miliardi di parametri, modificalo in **:4b**.

L'esecuzione di moduli sul tuo terminale aprirà un'esperienza chatbot familiare, che ti consentirà di scrivere i tuoi prompt e ricevere risposte, il tutto eseguito localmente sul tuo dispositivo.

Per uscire dal modulo e tornare a PowerShell, è sufficiente digitare **/bye** e il processo verrà terminato.

Questo articolo illustra le basi assolute per configurare Ollama sul tuo computer e utilizzare la suite di LLM a disposizione. L'esperienza di base è molto semplice e intuitiva, e non richiede praticamente alcuna conoscenza tecnica per la configurazione. Se ci sono riuscito io, puoi farcela anche tu!

I commenti sono chiusi.