I rischi dell'intelligenza artificiale aziendale: alternative a OpenAI e le istituzioni dietro gli agenti di intelligenza artificiale

Lacune nella privacy dei dati, nella conformità e nell'affidabilità nelle attuali integrazioni degli agenti di intelligenza artificiale

"Aspetta... stai inviando le voci del tuo registro a OpenAI?"

Questa è stata la prima cosa che mi ha chiesto la mia amica quando gliel'ho mostrato. Sentire-scrivere, un'app di journaling basata sull'intelligenza artificiale che ho sviluppato durante un hackathon a San Francisco.

Scrollai le spalle.

"Era un hackathon a tema intelligenza artificiale e dovevo creare qualcosa in fretta."

Non si è persa un attimo:

"Certo. Ma come posso fidarmi di quello che ho costruito? Perché non ospitare il tuo LLM?"

Ciò mi ha fermato.

Sono stato orgoglioso della rapidità con cui è stata realizzata l'app. Ma questa domanda, e quelle che seguirono, rivelarono tutto quello che pensavo di sapere sulla costruzione responsabile con l'intelligenza artificiale. Ne hanno parlato anche i giudici dell'hackathon.

Quel momento mi ha fatto capire quanto siamo irrispettosi quando costruiamo con l'intelligenza artificiale, soprattutto con strumenti che gestiscono dati sensibili.

Ho capito una cosa più grande:

Quando si costruisce con l'intelligenza artificiale, non si parla abbastanza di fiducia.

La sua risposta mi è rimasta impressa. Georgia von Minden è una data scientist presso l'ACLU, dove lavora a stretto contatto con problematiche legate alle informazioni personali identificabili in contesti legali e di diritti civili. Ho sempre apprezzato la sua intuizione, ma questa conversazione era diversa.

Così le ho chiesto di spiegarmi. Cosa significa realmente fiducia in questo contesto? Soprattutto quando i sistemi di intelligenza artificiale gestiscono dati personali.

Mi ha detto:

"La fiducia può essere difficile da stabilire, ma la governance dei dati è un buon punto di partenza. Chi possiede i dati, come vengono archiviati e per cosa vengono utilizzati sono tutti fattori importanti. Dieci anni fa avrei risposto diversamente a questa domanda. Ma oggi, con l'enorme potenza di calcolo e le vaste riserve di dati, l'inferenza su larga scala è una vera preoccupazione. OpenAI ha un accesso così ampio sia all'elaborazione che ai dati che la sua mancanza di trasparenza rende necessaria la cautela."

Quando si tratta di informazioni di identificazione personale (PII), sia le normative che il buon senso indicano la necessità di una solida governance dei dati. Inviare informazioni di identificazione personale tramite chiamate API non è solo rischioso, ma potrebbe anche violare queste regole e mettere a rischio le persone.

Mi ha ricordato che quando progettiamo con l'intelligenza artificiale, in particolare sistemi che gestiscono dati umani sensibili, non stiamo semplicemente scrivendo codice.

Prendiamo decisioni sulla privacy, sull'autorità e sulla fiducia.

Nel momento in cui raccogli dati utente, in particolare dati personali come le voci del diario, entri in uno spazio di responsabilità. Non si tratta solo di ciò che il tuo modello può fare. Il problema è cosa succede a quei dati, dove vanno e chi vi ha accesso. Una gestione responsabile dei dati degli utenti aumenta la fiducia degli stessi e ne migliora la privacy.

L'illusione della semplicità

Oggi è più facile che mai lanciare qualcosa che abbia un aspetto intelligente. Grazie ai grandi modelli linguistici (LLM) come OpenAI e altri, gli sviluppatori possono creare strumenti di intelligenza artificiale nel giro di poche ore. Le startup possono lanciare funzionalità basate sull'intelligenza artificiale da un giorno all'altro. E le istituzioni? Si sta affrettando a integrare questi agenti nel suo flusso di lavoro.

Ma in tutta questa eccitazione, una cosa spesso viene trascurata: fiducia.

Quando le persone parlano Agenti di intelligenza artificialeSpesso si riferiscono a semplici wrapper attorno a modelli linguistici di grandi dimensioni (LLM). Questi agenti possono rispondere a domande, automatizzare attività o addirittura prendere decisioni. Ma molti vengono realizzati in fretta, con poca attenzione alla sicurezza, alla conformità o alla responsabilità.

Usa semplicemente il prodotto per OpenAI Non significa che sia sicuro. Ciò di cui ti fidi veramente è l'intera pipeline:

- Chi ha realizzato la copertina?

- Come vengono gestiti i tuoi dati?

- Le tue informazioni vengono archiviate, registrate o, peggio, divulgate?

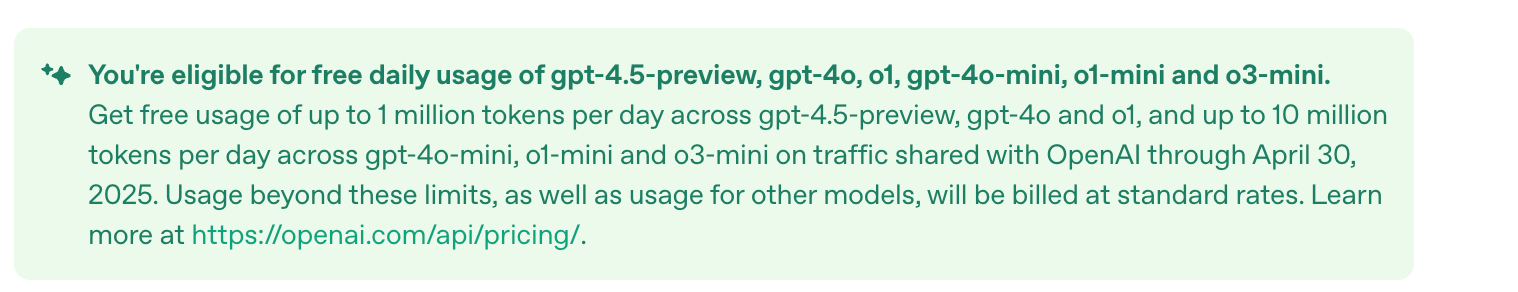

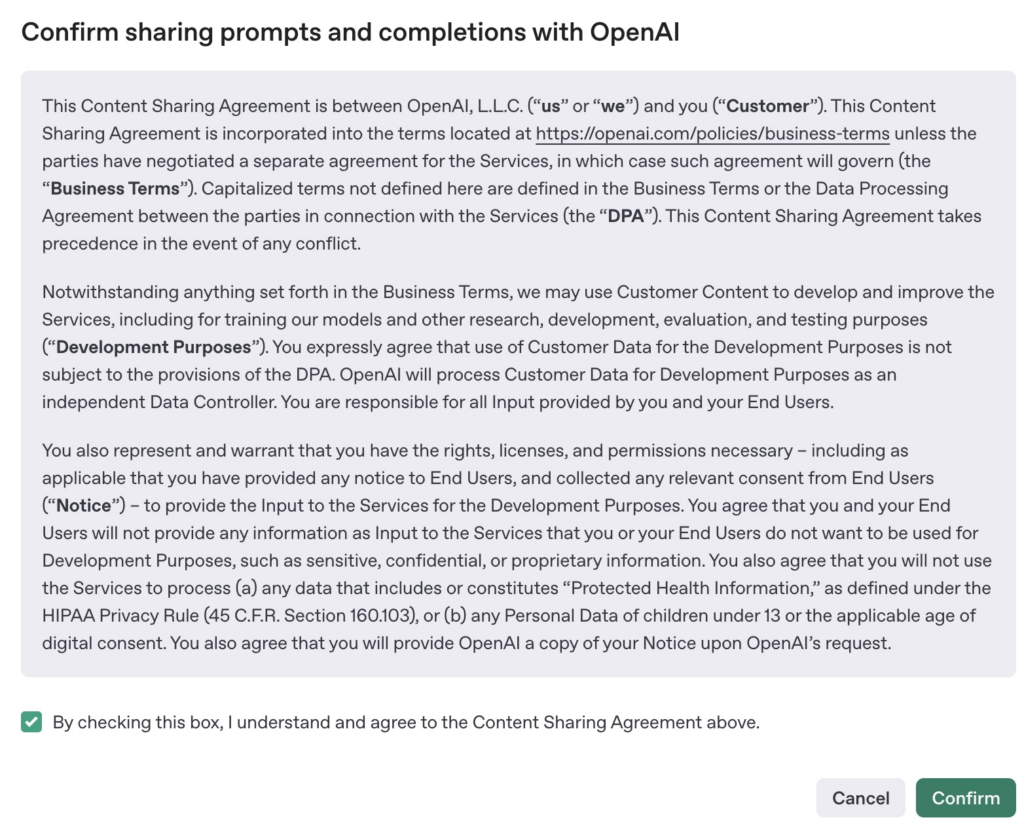

Personalmente ho utilizzato l'API di OpenAI per i casi d'uso dei clienti. Di recente mi è stato offerto l’accesso gratuito all’API – fino a 1 milione di token al giorno fino alla fine di aprile – Se accetto di condividere i dati dei miei reclami.

Stavo per accettare l'offerta per un progetto personale parallelo, ma poi mi è venuto in mente che se un fornitore di soluzioni accettasse lo stesso accordo per ridurre i costi, i suoi utenti non avrebbero idea che i loro dati vengono condivisi. A livello personale, questo potrebbe sembrare innocuo. Ma nel contesto dell'istituzione? Si tratta di una grave violazione della privacy e probabilmente anche degli obblighi contrattuali o normativi.

Basta che un solo ingegnere dica "sì" a un accordo come questo e i dati dei tuoi clienti finiranno nelle mani di qualcun altro.

L’intelligenza artificiale aziendale aumenta le aspettative

Vedo sempre più aziende SaaS e startup di strumenti di sviluppo sperimentare con gli agenti di intelligenza artificiale. Alcuni stanno ottenendo buoni risultati, con agenti di intelligenza artificiale che consentono agli utenti di utilizzare i propri modelli linguistici di grandi dimensioni (LLM), dando loro il controllo su dove il modello viene eseguito e su come i dati vengono elaborati. Questo è un approccio saggio, soprattutto ora che l'intelligenza artificiale sta diventando sempre più importante in azienda.

Questo è l'approccio ponderato: Tu stabilisci i limiti di fiducia..

Ma non tutti sono così entusiasti.

Molte aziende si limitano a connettersi all'API di OpenAI, aggiungono qualche pulsante e la definiscono "pronta per l'azienda".

Attenzione: questo non è vero.

Cosa potrebbe andare storto? molto.

Ecco i potenziali rischi che si possono correre se si integrano agenti di intelligenza artificiale nella propria infrastruttura senza porsi le domande più difficili:

- Perdita di datiI tuoi reclami potrebbero includere dati sensibili dei clienti, chiavi API o logica interna e, se inviati a un modulo di terze parti, potrebbero essere esposti.

Nel 2023, gli ingegneri Samsung hanno inavvertitamente incollato codice sorgente interno e note in ChatGPT (Forbes). Questi dati potrebbero ora far parte di futuri set di addestramento, con un rischio significativo per la proprietà intellettuale.

- Violazioni della conformitàL'invio di informazioni personali identificabili (PII) tramite un modulo come OpenAI senza controlli adeguati potrebbe violare il Regolamento generale sulla protezione dei dati (GDPR), l'HIPAA o i tuoi contratti.

L'azienda X di Elon Musk lo ha imparato a sue spese. Hanno lanciato il loro chatbot AI, "Grok", utilizzando tutti i post degli utenti, compresi quelli degli utenti dell'UE, per addestrarlo, senza il necessario abbonamento. Gli organizzatori intervennero rapidamente. Sotto pressione, hanno smesso di addestrare Grok nell'Unione Europea (Politico).

- comportamento vagoGli agenti non deterministici sono difficili da correggere o spiegare. Cosa succede quando un cliente chiede perché un chatbot ha fornito una raccomandazione sbagliata o ha rivelato qualcosa di riservato? Per rispondere a questa domanda è necessaria la trasparenza, ma oggi molti agenti non la forniscono.

- Confusione sulla proprietà dei datiChi è proprietario del prodotto? Chi registra i dati? Il fornitore del servizio si aggiorna sui tuoi input?

Zoom è stata sorpresa a fare esattamente questo nel 2023. Hanno modificato silenziosamente i loro termini di servizio per consentire l'uso dei dati delle riunioni con i clienti per addestrare l'intelligenza artificiale (Fast Company). Dopo le proteste dell'opinione pubblica, hanno fatto marcia indietro sulla politica, ma ciò è servito a ricordare che la fiducia può essere persa da un giorno all'altro.

- Difetti di sicurezza nell'imballaggioNel 2024, decine di distribuzioni di Flowise, un popolare strumento di orchestrazione LLM a basso codice, sono state trovate esposte a Internet, molte senza autenticazione (Notizie sulla sicurezza informatica). I ricercatori hanno scoperto pubblicamente chiavi API, credenziali di database e dati utente. Questo non è un problema di OpenAI: è un problema. Costruttori. Ma a pagarne il prezzo sono comunque gli utenti finali.

- Funzionalità dell'intelligenza artificiale che vanno troppo oltreLa funzione "Recall" di Microsoft, parte del lancio di Copilot, ha acquisito automaticamente screenshot dell'attività degli utenti per aiutare l'assistente AI a rispondere alle domande (DoublePulsar). Sembrava utile... finché gli esperti di sicurezza non lo hanno definito un incubo per la privacy. Microsoft ha dovuto fare rapidamente marcia indietro e rendere la funzionalità solo facoltativa.

Non tutto ha bisogno di OpenAI.

OpenAI è una piattaforma incredibilmente potente. Ma non sempre è la soluzione migliore.

A volte è più che sufficiente un modello locale più piccolo. Altre volte, la logica basata su regole funziona meglio. Spesso l'opzione più sicura è quella che opera interamente all'interno della tua infrastruttura, secondo le tue regole.

Non dovremmo limitarci a inserire ciecamente un modello linguistico di grandi dimensioni (LLM) e chiamarlo "assistente intelligente".

Nelle istituzioni, Fiducia, trasparenza e controllo non sono optional. - Anzi, è essenziale.

Sono sempre più numerose le piattaforme che consentono questo tipo di controllo. Einstein 1 Studio di Salesforce ora supporta la funzionalità porta il tuo modello, consentendoti di connettere il tuo modello linguistico di grandi dimensioni (LLM) da AWS o Azure. IBM Watson consente alle organizzazioni di distribuire modelli internamente con percorsi di controllo completi. Con MosaicML, Databricks ti consente di addestrare modelli linguistici di grandi dimensioni (LLM) privati all'interno del tuo cloud, in modo che i tuoi dati sensibili non lascino mai la tua infrastruttura.

Ecco come dovrebbe essere la vera intelligenza artificiale aziendale.

Conclusione

Gli agenti di intelligenza artificiale sono incredibilmente potenti e consentono flussi di lavoro e automazioni che prima non potevamo realizzare. Tuttavia, la facilità di sviluppo non significa necessariamente sicurezza, soprattutto quando si tratta di dati sensibili su larga scala.

Prima di iniziare a utilizzare questo nuovo agente scintillante, chiediti:

- Chi controlla il modello?

- Dove vanno i dati?

- Siamo conformi alle normative?

- Possiamo controllare cosa sta facendo?

Nell’era dell’intelligenza artificiale, la minaccia più grande non è la cattiva tecnologia, ma Fiducia cieca.

Informazioni sull'autore

Sono Ellen, un'ingegnere di apprendimento automatico con 6 anni di esperienza, attualmente lavoro presso una startup fintech a San Francisco. La mia esperienza comprende ruoli di data science nella consulenza nel settore petrolifero e del gas, nonché la conduzione di programmi di formazione su intelligenza artificiale e dati in Asia Pacifica, Medio Oriente ed Europa.

Sto attualmente completando il mio Master in Data Science (mi laureerò a maggio 2025) e sono attivamente alla ricerca della mia prossima opportunità come Machine Learning Engineer. Se fossi aperto a un consiglio o a un contatto, te ne sarei davvero grato!

Amo avere un impatto concreto sul mondo attraverso l'intelligenza artificiale e sono sempre aperto anche a collaborazioni basate su progetti.

I commenti sono chiusi.